Pesquisadores brasileiros usam IA para criar sistema de digitação de baixo custo com os olhos

Atualizado às 16h15 de 12/12/16

A inteligência artificial é a queridinha entre gigantes da tecnologia atualmente. E não é para menos. Existem muitas possibilidades de aplicação – já vimos até como ela pode ser usada para pegar político ladrão. Na USP, em São Carlos, o potencial da IA está sendo aproveitado para melhorar a vida de pessoas com deficiência motora, como portadores de esclerose lateral amiotrófica (ELA).

• Implante permite que mulher com paralisia soletre mensagens usando cliques cerebrais

• Pesquisadores brasileiros ensinam computadores a detectar câncer e cegueira a partir de fotos

Os pesquisadores da universidade estão utilizando técnicas de IA para baratear sistemas de digitação de computadores com os olhos, o que pode permitir que mais pessoas com limitações motora possam se comunicar.

“Falando cruamente, estamos desenvolvendo um método que tenta descobrir qual palavra um usuário tentou digitar com o olhar em um teclado virtual”, diz Raíza Hanada, pesquisadora do projeto.

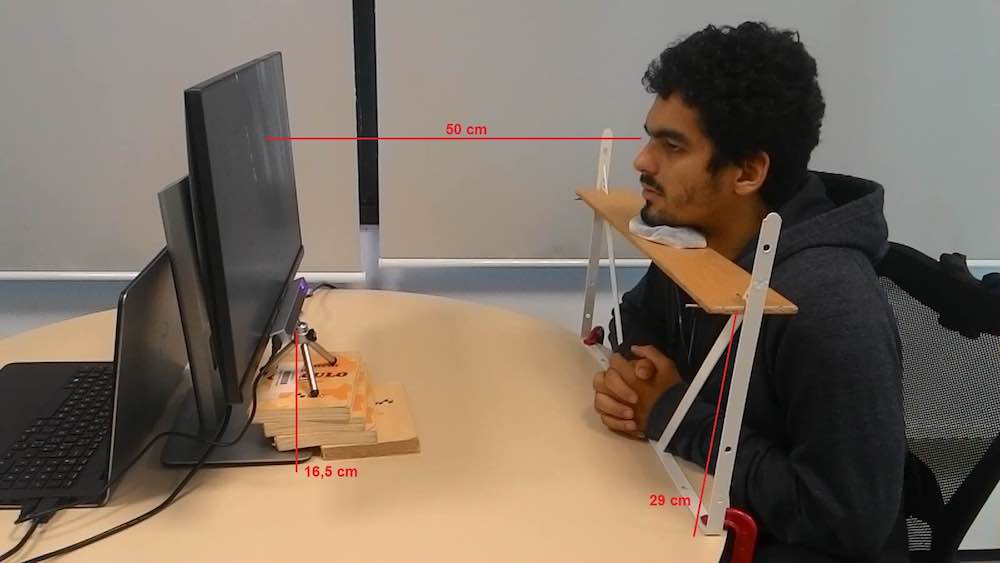

Teste de sistema de digitação pelos olhos feito por equipe de pesquisadores. Crédito: Arquivo Pessoal

Para os usuários e programadores de sistemas de digitação com os olhos, existem algumas dificuldades até que a palavra desejada seja finalmente digitada. O principal deles é que os olhos são utilizados tanto para fazer a busca das letras quanto para fazer a seleção das letras alvos – o que torna muito difícil distinguir qual letra um usuário de fato quis selecionar e quais letras o usuário apenas passou os olhos por cima por estarem no caminho entre dois alvos. Assim, é comum que o sistema acabe capturando todas as letras visualizadas.

Esse problema é conhecido como “Toque de Midas”, e contorná-lo não é moleza. O método mais comum é fazer a seleção de letras por meio de pequenas pausas, conhecidas como “dwell-time”. Assim, o usuário olha para a letra alvo durante uma quantidade preestabelecida de milissegundos e o sistema entende que esta é a letra que deve ser selecionada.

Mas, claro, a técnica tem limitações. Se o dwell-time for muito longo, a comunicação fica muito lenta e o desconforto para os usuários é grande. Por outro lado, se o dwell-time for muito curto, o sistema pode continuar entendendo que todas as letras devem ser selecionadas, fazendo com que o “Toque de Midas” permaneça. A ideia do projeto é eliminar o dwell-time e mesmo assim manter um alto grau de precisão na digitação.

Limpando ruídos

A pesquisa de Raíza utiliza IA para determinar qual é a probabilidade de problemas que afetem a digitação surgirem. Esses “problemas” são chamados de “ruídos”, o que ajuda a entender o nome da pesquisa “Modelos de Ruídos para Melhorar Técnicas de Digitação Ininterrupta com os Olhos”.

Sistema de predição desenvolvido pelo grupo de pesquisadores. Crédito: Arquivo Pessoal

A teoria do canal de ruídos considera que existe uma fonte de dados correta (exemplo: a palavra “ilha”), que durante o seu percurso até o destino final encontrou uma fonte ruidosa que a distorceu. Dessa forma, a palavra chega distorcida ao destino final (exemplo: a palavra chega como “ioljha”). O objetivo do modelo de ruídos da pesquisa é tentar descobrir qual era a palavra inicial, com base em inferência bayesiana. Você pode ler mais sobre a pesquisa aqui.

O modelo consegue lidar com problemas típicos de quem está digitando com os olhos, como o caso de quando o usuário não sabe onde está a letra que deseja digitar e fica procurando-a. A pesquisa também combina probabilidades de erros de digitação típicos de teclado manual, probabilidades de erros de digitação típicos de teclado virtual para os olhos e probabilidades de haver imprecisão do eye-tracker.

• Controlar o laptop com os olhos: será que agora vai?

Assim, é possível ranquear as palavras candidatas e sugeri-las ao usuário, mais ou menos como o corretor do smartphone faz.

Por enquanto, a pesquisa está sob testes. No final de outubro, seis pessoas sem deficiência motora utilizaram o sistema, e os resultados estão sob análise. Mesmo assim, o modelo já é considerado satisfatório.

Acesso

Se tiver sucesso, o trabalho dos pesquisadores pode aumentar o acesso de pessoas com limitações motoras a sistemas de digitação visual. Isso porque os eye-trackers, o equipamento que captura a posição dos olhos em uma tela, mais sofisticados podem passar dos US$ 10 mil – e uma boa parte do preço normalmente é equivalente ao software que acompanha o equipamento.

Nos modelos mais baratos, os eye-trackers acabam sendo menos precisos e mais lentos. Assim, pode ser comum que o tracker detecte que um usuário está olhando para uma determinada letra quando, na verdade, ele gostaria de estar olhando para a letra ao lado.

Além disso, os trackers podem ter problemas relacionados a variações no sistema ótico (por exemplo, micro-movimentos que fazemos involuntariamente com os olhos), problemas na memória visual do usuário (como no caso de um usuário não lembrar onde fica determinada letra e realizar ações de busca pela letra durante a digitação) e problemas relacionados com a própria interface do sistema.

O modelo pesquisado promete superar todos esses obstáculos a um preço bem mais acessível. Os pesquisadores utilizaram um modelo da Tobii de US$ 119 e outro da EyeTribe que foi comprado por US$ 99 (atualmente, ele sai por $199).

Sistema da Eyetribe consiste em um conjunto de câmeras que monitora os olhos do usuário. Crédito: Eyetribe

Limitações

Infelizmente, o modelo da pesquisa ainda não contempla a língua portuguesa, o que dificulta a adoção da tecnologia por usuários brasileiros. Funciona só em inglês.

O principal motivo é a ausência de dados em relação ao conjunto de erros de digitação em português. É aquela velha história: para a IA pensar, ela precisa ser alimentada com um bom conjunto de dados. Assim, o teclado virtual utilizado pelos pesquisadores nem mesmo contemplam os acentos ortográficos da nossa língua.

Isso, claro, impacta na hora de encontrar candidatos para realizar os testes. Entre aqueles que participaram das pesquisas, não havia nativos do inglês. Todos eram pessoas que tinham vivido acima de 9 meses em um país de língua estrangeira e se comunicando apenas em inglês.

Mesmo assim, segundo Raíza, foi possível garantir a fluência dos participantes no idioma. Os testes consistiam em transcrever frases pré-determinadas que eram sugeridas. Cada participante fez três sessões de transcrições. Em cada sessão, haviam quatro blocos de cinco minutos de escrita, com dois minutos de intervalo entre cada bloco para evitar que o participante se sentisse cansado.

A boa notícia é que o método pode ser adaptado para o português, que, claro, depende de ajustes. O grupo de Raíza está em contato com um estudante de iniciação científica da UFSCar, Guilherme Ramos, que está desenvolvendo um outro método de digitação visual. Os testes com esse método serão em português.

Reconhecimento

O projeto chamou a atenção de um dos grandes interessados em IA no mundo. Sim, estamos falando do Google. A equipe submeteu a pesquisa ao programa de Bolsas de Pesquisa Google para a América Latina e foi uma das 24 contempladas) entre 473 concorrentes.

“A ideia era poder realizar os experimentos com usuários em um país de língua inglesa e estamos averiguando quando e como iremos fazer isso”, diz Hanada.

Por ora, a pesquisadora receberá mensalmente durante 12 meses US$ 1.200 (outros US$ 750 serão pagos à professora e orientadora da pesquisa Maria da Graça Pimentel). O dinheiro começou a chegar no mês passado, mas a premiação rolou no último mês de agosto, em Belo Horizonte.

Com a ajuda do Google, e seu interesse constante em IA, é possível que o projeto avance. Possibilitar a comunicação de pessoas que poderiam ficar confinadas aos próprios corpos não parecia estar no radar de empresas de IA. Felizmente, parece existir um novo caminho. Vamos aguardar.

Imagem do topo por Tobii/Divulgação