Agora dá para corrigir perfeitamente fotos tiradas na escuridão quase completa usando deep learning

Normalmente, existem duas maneiras de tirar fotos utilizáveis em ambientes de pouca luz. Você pode ou usar um obturador lento, que exige um tripé para eliminar borrões, ou aumentar eletronicamente a sensitividade do sensor da câmera, o que traz objetos com um ruído feio. Mas agora existe uma terceira forma de fazer isso, que se aproveita do aprendizado de máquina para aumentar artificialmente o brilho de uma foto escura — e com resultados impressionantes.

• Conseguiram tirar o bigode do Super-Homem da Liga da Justiça só com IA e um PC barato

• Agora você pode buscar imagens pela composição no Shutterstock, graças ao deep learning

Pesquisadores da Intel e da Universidade de Illinois em Urbana-Champaign criaram o que pode ser a ferramenta definitiva de pós-produção para fotógrafos que frequentemente se veem registrando imagens em cenários de pouca luz, como shows, ou capturando a vida selvagem à noite. Porém, esse método pode ser usado até para melhorar a qualidade de fotos de smartphone que você tirou em um bar escuro e decadente.

Assim como com várias outras inovações de processamento de imagem recentes, a pesquisa, publicada em um artigo chamado “Learning to See in the Dark” (“Aprendendo a Enxergar no Escuro”, em tradução livre), usa técnicas de deep learning para treinar um algoritmo para saber como o brilho e as cores de uma imagem de pouca exposição devem ser devidamente corrigidos durante o pós-processamento. Os pesquisadores alimentaram uma rede neural com um conjunto de dados contendo 5.094 imagens extremamente escuras e com baixa exposição, assim como um número igual de imagens de longa exposição que mostravam como a cena deveria ser com a luz e a exposição apropriadas. As imagens foram capturadas com uma Sony α7S II e uma Fujifilm X-T2, que usam tecnologias de sensor diferentes.

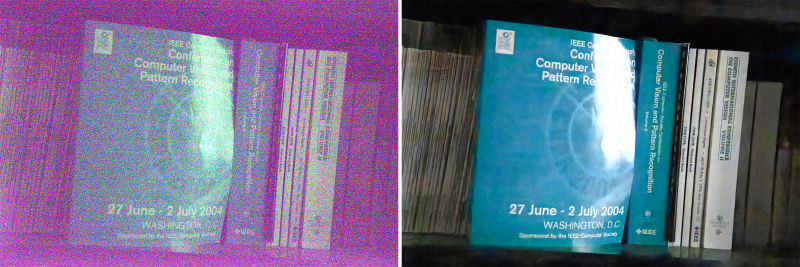

(Esquerda) Uma foto com pouca exposição corrigida usando ferramentas de processamento de imagem tradicionais. (Direita) A mesma imagem corrigida usando os algoritmos de deep learning (Foto: Universidade de Illinois em Urbana–Champaign & Intel)

Como alguém que sempre lutou contra o Photoshop para arrumar imagens escuras e granuladas, para mim, os resultados desse algoritmo, mesmo nos estágios iniciais de pesquisa, são bastante impressionantes. As fotos vão de algo destinado à lixeira do seu computador para imagens genuinamente utilizáveis, em certo ponto.

(Esquerda) Uma foto com pouca exposição corrigida usando ferramentas de processamento de imagem tradicionais. (Direita) A mesma imagem corrigida usando os algoritmos de deep learning (Foto: Universidade de Illinois em Urbana–Champaign & Intel)

As fotos processadas ainda não estão tão boas quanto ficariam se a mesma cena tivesse sido fotografada com uma longa exposição e um tripé, mas quem quer carregar por aí todo aquele equipamento extra quando tudo que se quer fazer é tirar fotos rápidas de noite com seus amigos? Vai levar muito tempo até que os pequenos sensores dentro dos smartphones tenham a mesma capacidade dos sensores comparativamente gigantes usados em câmeras DSLR. Porém, com esse algoritmo rodando em segundo plano no app de câmera do seu celular, talvez eles nunca precisem ter essa capacidade.

Em câmeras digitais, o hardware físico é tão importante quanto o software que processa o que o sensor captura. É concebível que uma simples atualização de software possa, um dia, fazer com que as suas fotos no iPhone façam frente às das câmeras mais caras de Canon e Nikon.

[Learning to See in the Dark via BoingBoing]

Imagem do topo: Reprodução