Google se desculpa por erro em algoritmo que marcava negros como gorilas

O Google Fotos é uma ferramenta sensacional que pode mudar o armazenamento de fotos assim como o Gmail mudou o e-mail. Só que ela ainda precisa resolver alguns problemas no algoritmo que analisa as imagens.

>>> 10 truques para você se tornar um mestre do novo Google Fotos

Um dos principais recursos no Google Fotos é reconhecer automaticamente pessoas, animais, objetos e locais em suas fotos. Só que o programador Jacky Alciné notou uma falha ofensiva: o algoritmo estava marcando como “gorila” várias fotos em que ele aparece com uma mulher negra.

Jacky reclamou no Twitter…

And it's only photos I have with her it's doing this with (results truncated b/c personal): pic.twitter.com/h7MTXd3wgo

— diri noir avec banan (@jackyalcine) June 29, 2015

… e recebeu uma resposta pouco tempo depois: Yonatan Zunger, do Google+, prometeu uma solução no mesmo dia. Ele confirmou que a tag “gorila” foi removida da base de dados, mas a equipe ainda tem mais trabalho pela frente.

Zunger diz que “até recentemente, o algoritmo estava confundindo rostos brancos com cachorros e focas“, e “pessoas de todas as raças eram marcadas como cachorros“. Isso acontece porque o reconhecimento de imagens não é exatamente simples: é preciso usar “processamento de contraste diferente para tons de pele e iluminação diferentes”, diz ele.

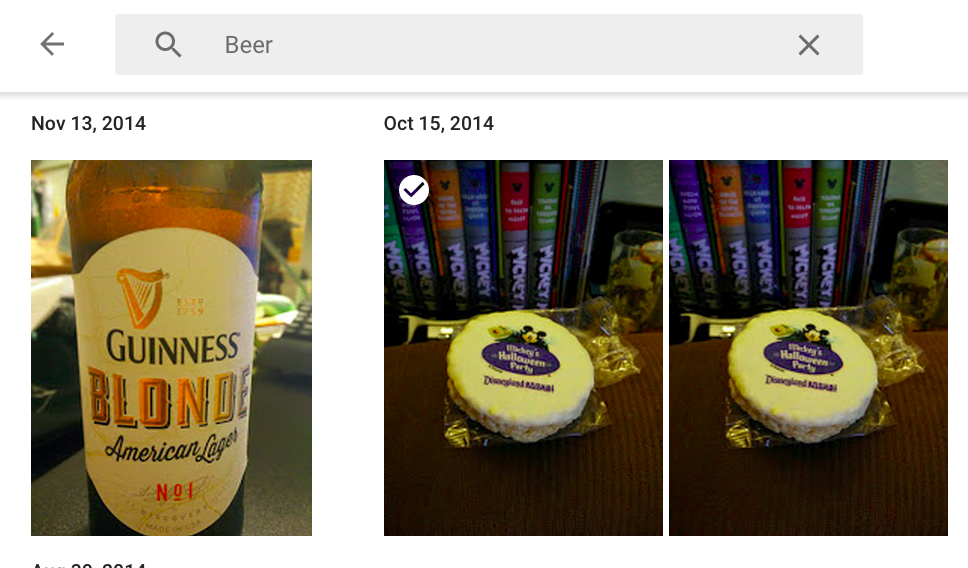

O Gizmodo já reparou em alguns erros do algoritmo antes. Por exemplo, o Google Fotos achava que este doce do Mickey Mouse era uma tampa de cerveja…

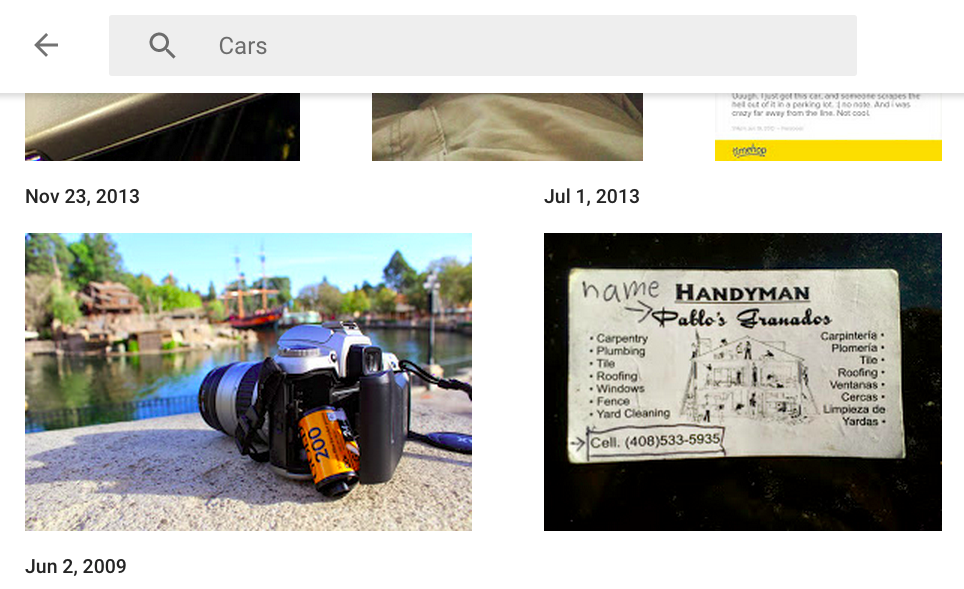

… marcou esta câmera fotográfica como um carro…

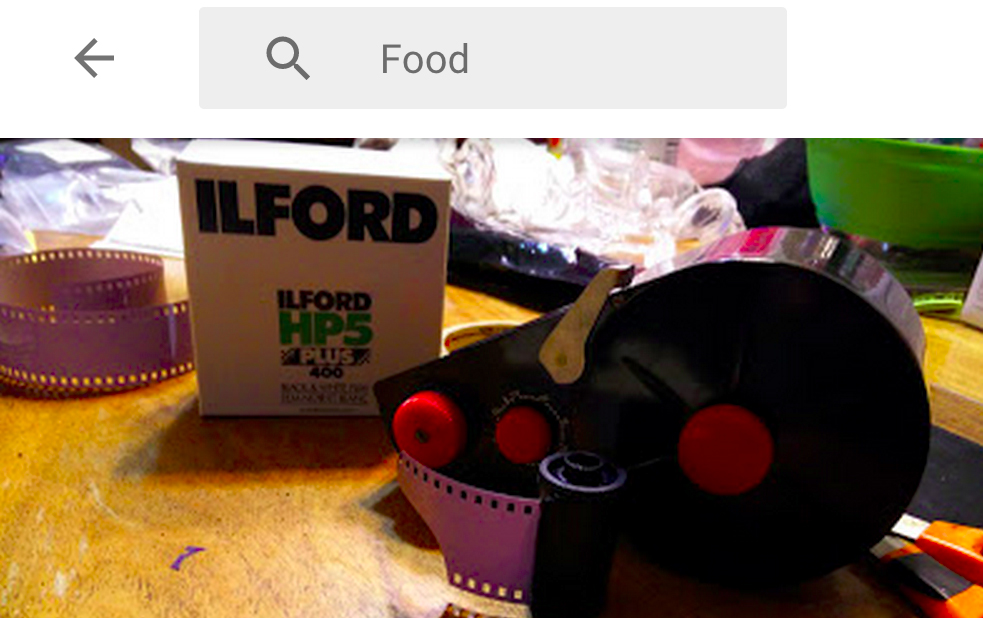

… e dizia que este filme fotográfico era comida:

Mas nenhum erro tinha o potencial de ofender pessoas, daí a resposta rápida do Google.

O Google Fotos é um serviço ambicioso: ele oferece espaço ilimitado para fotos e vídeos (com limites máximos de resolução), criação automática de GIFs animados e álbuns, e filtros inteligentes. Então é de se esperar que o serviço passe por alguns percalços.

Em comunicado, o Google diz ao Ars Technica que “ainda há claramente um monte de trabalho a se fazer na rotulagem automática de imagem, e nós estamos analisando como podemos evitar que esse tipo de erro aconteça no futuro”. [Ars Technica]