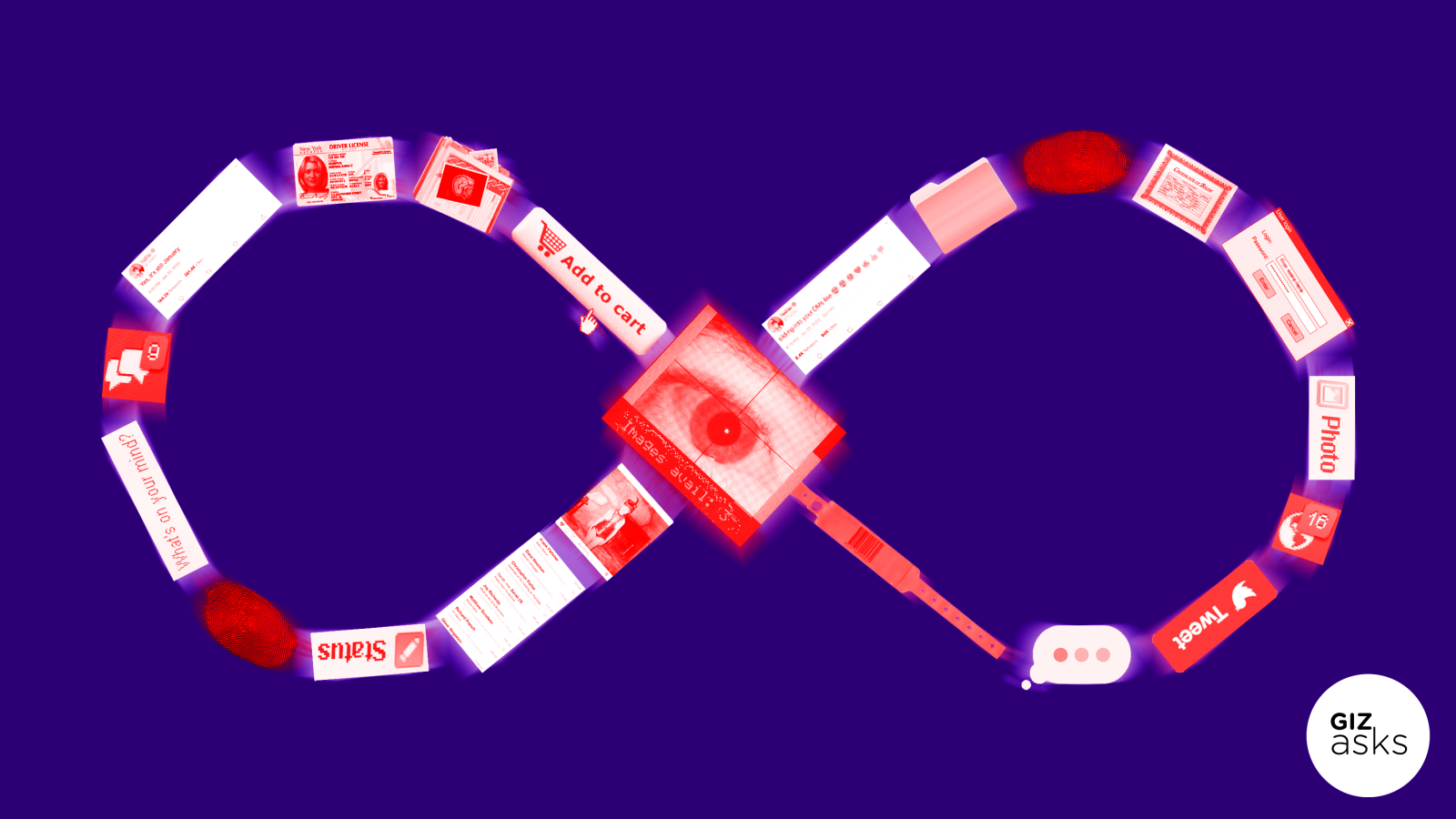

Todos nós praticamente nos reconciliamos com o fato de que um punhado de intocáveis executivos de tecnologia, com a nossa ajuda, gerou o maior repositório de informações pessoais já reunido, alojado em vastos complexos fortificados em todo o mundo e peneirados continuamente para o benefício de corporações, agências federais, campanhas políticas, etc. Menos clara é a vida útil de tudo o que eles coletaram. Eles realmente vão se apegar a essas coisas para sempre? E se eles vão, e se preferimos que não o fizessem, há algo que podemos fazer a respeito? Para o Giz Pergunta desta semana, contatamos vários especialistas para descobrir.

De modo geral, a tendência é que os dados fiquem para sempre, no entanto, uma grande preocupação dos especialistas é em como as informações são utilizadas para empresas em modelos protegidos por segredos comerciais.

Meg Leta Jones

Professora Associada de Comunicação, Cultura e Tecnologia da Universidade de Georgetown, que pesquisa regras e mudanças tecnológicas com foco em privacidade, proteção de dados e automação em informações digitais e tecnologias de computação.

Nada é “para sempre”. A internet popular e comercial tem apenas 25 anos, a internet após a “crise ponto com” do ano 2000 tem apenas 20 anos e o Facebook apenas 15.

A maior parte do que estava online nas décadas de 1980 e 1990 desapareceu, assim como a maior parte da internet inicial. Sites, fóruns e plataformas vêm e vão. Apodrecimento de links e apodrecimento de bits assola os arquivos e registros históricos.

Os dados digitais são incrivelmente frágeis e muitas coisas precisam ocorrer em várias camadas para que meu computador possa solicitar e receber um arquivo do seu computador. O acesso requer manutenção e poucas pessoas (por exemplo, amadores dedicados), organizações (por exemplo, grupos de notícias) ou instituição (por exemplo, arquivos) têm a motivação e os recursos para manter os dados digitais por longos períodos de tempo.

Quanto tempo os “meus” dados permanecem online também depende de quem eu sou. Se eu sou uma pessoa famosa, posso ter gerado o interesse de muitos mantenedores de dados e aumentado a probabilidade de acesso a longo prazo. Também posso ter dificuldade em exercer meu direito de ser esquecido, que um número crescente de pessoas ao redor pode utilizar como figura pública.

Se eu puder efetivamente exercer o direito de ser esquecido, meus dados poderão não estar online por muito tempo. Meus dados também podem ser considerados dados ou fala de outra pessoa. Nesse caso, provavelmente sou americano e posso esperar que a gigante da tecnologia que mantém meus dados seja comido por outro gigante da tecnologia, que matará o site/conteúdo/banco de dados.

O fato de os meus dados estarem “online” também pode mudar, mesmo que não sejam apagados da fonte. Hoje, pode haver vários obstáculos que impedem alguém de acessar facilmente meus dados, mesmo que estejam online em algum lugar.

Muitos europeus exerceram seu direito de serem esquecidos após um processo judicial da União Europeia em 2014, solicitando que o Google desindexasse determinados resultados de pesquisa. A menos que o titular dos dados também tenha procurado apagar com sucesso a fonte real, os dados ainda estavam online – mas como alguém saberia? As organizações de notícias e as pesquisas de pessoas trouxeram paywalls e assinaturas para acessar conteúdo antigo e sites de redes sociais possuem camadas de configurações de privacidade que podem revelar dados para alguns, mas não para outros.

Não devemos ter medo de registros permanentes. Devemos ter medo da dinâmica do poder informacional que traz consequências imediatas e prejudiciais e uma séria falta de infraestrutura de preservação para a cultura contemporânea.

“Quanto tempo os ‘meus’ dados permanecem online também depende de quem eu sou”.

Fred H. Cate

Vice-Presidente de Pesquisa, Professor de Direito e Membro Sênior do Centro de Pesquisa Aplicada em Cibersegurança da Indiana University

Companhias (e agências governamentais) coletam quantidades extraordinárias de informações pessoais sobre indivíduos o tempo todo. Essa coleta ocorre através de uma ampla variedade de meios: dispositivos portáteis, triangulação em telefones celulares, câmeras de vídeo, aplicativos, e-mail, navegação na web, programas de fidelidade, transações online, ferramentas de pagamento etc.

A grande maioria dessas informações realmente não está “online” no sentido de que as pessoas podem procurar informações próprias ou de outras pessoas. De fato, alguém pode argumentar que mais deve estar disponível “online”, para que você possa ver (e possivelmente até corrigir) o que foi coletado sobre você, e para que a monopolização de dados não oculte novos participantes em mercados importantes.

Mas esses dados coletados, que geralmente são compartilhados com outras empresas ou corretores de dados de terceiros, existirão o mais próximo possível da eternidade. Realmente não há limites legais nos Estados Unidos aplicáveis à grande maioria dos dados, e os chamados limites legais em outros lugares não costumam chegar a muito, porque geralmente há um uso legítimo dos dados – para pesquisa ou treinamento em ferramentas de IA ou segurança – que tem o efeito de cobrar limites no armazenamento de dados.

Além disso, muitos dos dados, mesmo em países com limites de armazenamento aparentes, são mantidos por pessoas que simplesmente não se importam com esses limites. Com que frequência a maioria dos usuários checa os seus contatos, e-mails ou fotos para excluir dados desatualizados ou sem uso legítimo?

Para mim, isso sugere que a atenção à coleta ou armazenamento de dados provavelmente está completamente bagunçada e pode, em muitos contextos, ser totalmente impraticável. É como pedir às pessoas para organizar o ar ou a água do oceano. Em vez de focar nos dados (como no termo “proteção de dados”), não devemos nos concentrar nas pessoas e nas comunidades e no bem e no dano que podem ser causado com os dados?

Eu diria que é muito mais útil e mais prático focar no que pode ser feito com os dados, não importa quantos anos tenham ou como foram coletados – como esses dados podem ser usados?

Assim, poderíamos identificar usos prejudiciais ou censuráveis ou suscetíveis de causar ofensa e proibi-los completamente ou exigir consentimento explícito e opcional. Podemos permitir outros usos, por exemplo, talvez para pesquisa, desde que sejam tomadas precauções de segurança razoáveis.

Fazemos algo semelhante em outras áreas com as quais nos preocupamos como sociedade, para que possamos procurar, por exemplo, ferramentas que funcionem bem e sejam escalonáveis. Por exemplo, quase todas as pesquisas com seres humanos nos EUA e na Europa são feitas de acordo com os Comitês de Revisão Institucional ou os Comitês de Ética em alguns casos, que requerem consentimento individual e, em alguns casos, dizem que o consentimento não é prático ou não é necessário. Por que não exigir o uso de um “Quadro de Revisão de Dados” para fornecer supervisão e responsabilidades semelhantes?

“Em vez de focar nos dados (como no termo ‘proteção de dados’), não devemos nos concentrar nas pessoas e nas comunidades e no bem e no dano que lhes pode ser causado com os dados?”

Anu Bradford

Professora de Direito e Organização Internacional da Columbia Law School, pesquisadora sênior da Columbia Business School e autora de The Brussels Effect: How The European Union Rules the World (O Efeito de Bruxelas: Como a União Européia Governa o Mundo)

Não necessariamente [os dados ficam online para sempre], diz a União Européia. A Lei Geral sobre a Proteção de Dados da União Européia (LGPD) concede aos indivíduos o direito de solicitar que as plataformas da internet apaguem permanentemente determinados dados sobre si mesmos nos casos em que esses dados são imprecisos ou não são mais relevantes.

Este conceito de apagamento de dados – conhecido como “o direito de ser esquecido” – foi estabelecido pela primeira vez pelo mais alto tribunal europeu em um caso no Google Espanha.

Nesse caso, um usuário na Espanha solicitou que o Google removesse dos resultados de seus mecanismos de pesquisa que o vinculavam a antigos artigos de jornal detalhando seus problemas financeiros. Segundo esse usuário, as informações, embora precisas, não eram mais relevantes, pois todas as suas dívidas foram pagas. O Google se recusou a desvincular as informações. No final, o tribunal europeu forçou o Google a desconectar permanentemente as informações solicitadas e garantir que elas não fossem mais pesquisáveis. Desde então, esse direito foi codificado na LGPD. Também foi adotada por vários países ao redor do mundo, pois promulgaram leis de privacidade modeladas a partir da LGPD.

O direito de ser esquecido tem sido tanto controverso quanto eficaz. Seus críticos afirmam que o apagamento de informações de plataformas mina a liberdade de expressão e sufoca o debate público. Por exemplo, os tribunais dos EUA rejeitaram categoricamente o direito de ser esquecido e favoreceram as considerações de liberdade de expressão sobre a privacidade individual.

Para consternação de seus críticos, o direito de ser esquecido da União Europeia também é efetivo: leva a cancelamentos de registro significativos devido aos incentivos assimétricos que a LGPD impõe aos mecanismos de busca.

Embora empresas individuais como o Google mantenham a autoridade para tomar decisões em casos individuais sobre a exclusão de informações, é provável que qualquer caso limítrofe resulte na remoção das informações dos resultados da pesquisa. A falha no apagamento das informações pode levar a multas pesadas – até 4% do faturamento global da empresa – enquanto a desconexão excessiva não gera penalidade, incentivando o apagamento dos dados.

Como evidência da capacidade de resposta da empresa aos pedidos de desvinculação, o Google concordou em remover cerca de 44% dos 2,8 milhões de pedidos recebidos desde a decisão de maio de 2014, de acordo com seu relatório de transparência de maio de 2019.

O direito a ser esquecido é um dos muitos exemplos da UE que exerce sua autoridade reguladora na economia digital. Embora os EUA tenham relegado amplamente a regulamentação da privacidade de dados ao setor privado, a UE avançou com extensas regulamentações que estão moldando as práticas comerciais dos governos multinacionais.

Hoje, a maioria das grandes empresas de tecnologia elabora suas políticas globais de privacidade de dados com a União Européia em mente. Por exemplo, Facebook, Google e Microsoft têm uma política de privacidade global, que segue de perto a LGPD.

Da mesma forma, o Facebook, o Twitter e o YouTube adotaram a definição da UE de discurso de ódio em todo o mundo ao decidir que tipo de conteúdo remover das suas plataformas. Como resultado, geralmente é Bruxelas que decide como seus dados são armazenados, processados, compartilhados, transferidos ou apagados – e, portanto, se ficarão online para sempre.

“Enquanto empresas individuais como o Google mantém a autoridade para tomar decisões em casos individuais sobre a exclusão de informações, é provável que qualquer caso limítrofe resulte na remoção das informações dos resultados de pesquisa”.

Sandra Wachter

Professora Associada e Pesquisadora Sênior em Direito e Ética da IA, Big Data e robótica, além de Regulamento da Internet no Oxford Internet Institute da Universidade de Oxford e Professora Visitante Associada de Direito na Universidade de Harvard

A estrutura da UE para a LGPD é um fantástico primeiro passo em termos de tentativa de garantir – em toda a Europa e talvez até além dos limites da União Europeia – proteções básicas de privacidade para dados pessoais.

Infelizmente, a LGPD e a lei de proteção em geral estão mais focados no estágio de entrada do que no estágio de saída. Não regula o que pode ser, ou deveria ser, inferido a partir das informações de uma pessoa. Uma empresa pode ter que pedir seu consentimento para coletar seus dados de localização geográfica, mas você não tem idéia do que está sendo inferido a partir deles. E isso é importante, porque o potencial para danos invasivos à privacidade não ocorre necessariamente no estágio de entrada, no qual você fornece informações para uma empresa.

O estágio interessante vem depois, quando o aprendizado de máquina e a IA são aplicados a esses dados, um processo que pode derivar muitas informações potencialmente muito íntimas: sua orientação sexual, seu status de moradia, sua religião, suas crenças políticas, potenciais deficiências, sua identidade de gênero. O usuário geralmente não tem idéia de que os dados que deram podem realmente revelar essas coisas.

Parte da dificuldade em regular esse aspecto da situação é que as pessoas podem argumentar que esses processos são protegidos por segredos comerciais. Eles podem argumentar que os recursos investidos na coleta e análise dos dados transformam isso em propriedade da empresa ou do setor público. Há uma batalha interessante no horizonte quando se trata de quem deve ter poder sobre dados inferidos derivados de dados aparentemente neutros e entregues voluntariamente, e se o usuário deve ou não ter algum controle sobre isso.

Tomemos, por exemplo, o Apple Card, o sistema de pontuação de crédito usado pela Apple. A pontuação de crédito inferida pela Apple são dados pessoais do cliente, ou da empresa? Se forem dados pessoais, você poderá corrigir essa pontuação? E que implicações isso tem para a empresa e para o indivíduo? Você deve apagar a sua pontuação de crédito?

Atualmente, estou trabalhando em um projeto de pesquisa que será executado nos próximos dois anos, chamado IA e o direito a inferências razoáveis, no qual afirmo que precisamos observar padrões normativos eticamente aceitáveis e analíticos inferenciais, porque no momento não temos governo e nenhum padrão de como eles devem ser usados com responsabilidade. Você precisa encontrar um equilíbrio muito bom entre os direitos de proteção do indivíduo e os interesses dos negócios.