Pesquisadores criam método para dificultar o trabalho de algoritmos de reconhecimento facial

Em 2020, dá para imaginar que tudo que você posta nas redes sociais pode eventualmente chegar às mãos de alguma empresa obscura de mineração de dados, de autoridades federais ou de ambos.

Por outro lado, estar ciente de como essas empresas são sujas levou muitas pessoas a criar maneiras novas e criativas de escapar desse tipo de vigilância. Alguns desses métodos, como usar máscaras ou pintar o rosto, podem teoricamente impedir que suas fotos sejam roubadas, mas você acaba tendo que alterar muito sua própria aparência. Mas agora, uma equipe da Universidade de Chicago criou uma tática muito mais sutil e ainda assim efetiva contra esse tipo de algoritmo de espionagem.

O sistema é chamado de “Fawkes” — uma homenagem à máscara de Guy Fawkes que, de alguma maneira, se tornou símbolo do coletivo on-line Anonymous. A equipe de Chicago começou a trabalhar nele no final do ano passado como uma maneira de frustrar empresas como a Clearview AI, que criam grandes bancos de dados de rostos raspando dados de posts públicos.

“Acreditamos que a Clearview.ai provavelmente seja apenas a ponta (bastante grande) do iceberg”, escreveu a equipe. “Se pudermos reduzir a precisão desses modelos para torná-los não confiáveis ou forçar os proprietários a pagar custos significativos por pessoa para manter a precisão, já seria um sucesso.”

Quando uma empresa de reconhecimento facial como a Clearview é treinada para reconhecer a aparência de uma determinada pessoa, esse reconhecimento acontece ao fazer a ligação entre uma foto de um rosto (por exemplo, de um perfil do Facebook) a outra foto deste mesmo rosto (por exemplo, de uma foto de passaporte) e encontrar semelhanças entre as duas fotos.

De acordo com a equipe de Chicago, isso não significa apenas encontrar geometria facial ou cor de cabelo ou marcas na pele correspondentes, mas também identificar relações invisíveis entre os pixels que compõem uma imagem gerada por computador dessa face.

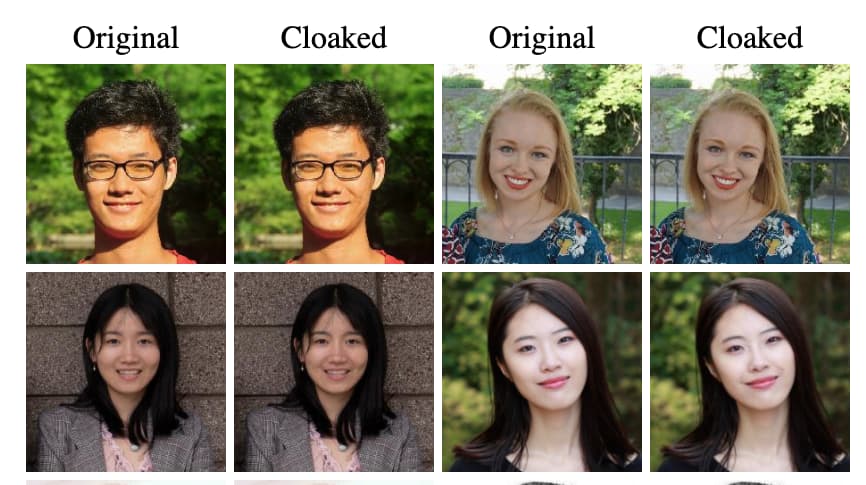

Ao trocar ou distorcer alguns desses pixels, o rosto ainda pode ser reconhecido por você ou por mim, mas seria registrado como uma pessoa completamente diferente por praticamente todos os algoritmos de reconhecimento facial mais famosos. De acordo com a pesquisa da equipe, essa técnica de “camuflagem” conseguiu enganar os sistemas de reconhecimento facial usados pela Microsoft, Amazon e Google em 100% do tempo.

Se você quiser dar uma olhada nesse item, a boa notícia é que a equipe da Universidade de Chicago disponibiliza o programa Fawkes gratuitamente para download em seu site. Se você tem uma imagem que deseja proteger de bisbilhoteiros ou raspadores de dados, pode carregá-la no Fawkes, que embaralha esses pixels invisíveis. O processo dura cerca de 40 segundos por fotografia, segundo os pesquisadores.

Você pode fazer o upload da nova foto, que foi secretamente codificada, para a rede social de sua preferência sabendo que se, digamos, uma empresa como a Clearview vasculhar suas fotos públicas, essa em particular provavelmente não será conectada a nenhum dos seus outros detalhes digitais online.

É verdade que o programa Fawkes não deve ser uma bala de prata contra essas empresas ou mesmo outras. Na verdade, ele quer ser é uma dor de cabeça para elas. “O Fawkes foi projetado para aumentar significativamente os custos de construção e manutenção de modelos precisos para o reconhecimento facial em larga escala”, eles escrevem, apontando que qualquer um de nós seria mais capaz de “identificar uma pessoa-alvo em um tempo igual ou menor” usando nossos próprios olhos em vez de recorrer a software de reconhecimento facial.

Mas, francamente, qualquer ação que torne o negócio de coleta de dados de face menos lucrativo para mim já é uma vitória.