Pesquisadores criam robô que provoca humanos e descobrem que as máquinas podem nos tirar do sério

Trash talk é o nome dado à prática de falar e provocar adversários como forma de desestabilizá-los emocionalmente, bastante comum nos esportes americanos e nas lutas — algo parecido com o que conhecemos aqui como catimba. É uma ferramenta eficaz (mas quase nunca admitida) quando se trata de esportes, jogos e outras competições.

Muita gente acredita que essa é uma estratégia que só funciona entre seres humanos que podem fazer comentários com peso emocional. Mas talvez não seja bem assim, como pesquisadores da Universidade Carnegie Mellon descobriram depois de programar um robô dócil para fazer trash talk com um oponente humano.

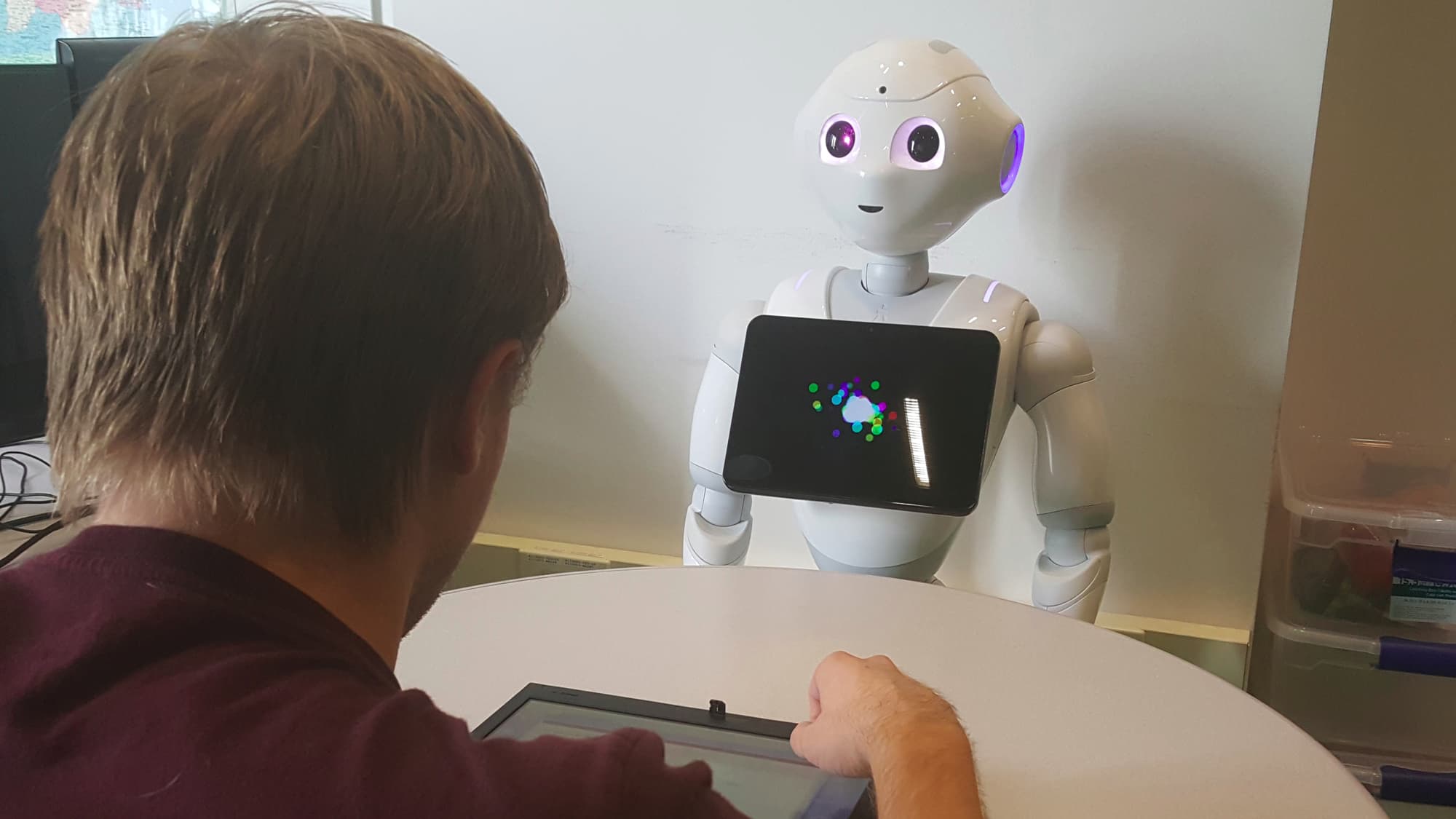

O robô em questão era um Pepper, da Softbank. Ele é um dos poucos robôs implantados em larga escala que lidam diretamente com seres humanos, respondendo a perguntas em museus ou dando informações a viajantes em aeroportos.

É o robô menos assustador que você pode imaginar, e sua conversa fiada — que inclui frases como “eu sou obrigado a dizer que você é um péssimo jogador” ou “ao longo da partida, seu jogo ficou confuso” — não é exatamente o tipo de coisa que acabaria em briga no bar.

O Pepper disputou 35 partidas com cada um dos 40 participantes de um estudo. Os humanos eram tecnologicamente experientes e sabiam que era um robô sem emoção e pré-programado que estava fazendo o trash talk. Mesmo assim, quem ouvia as provocações não pontuava tão bem nem mostrava tanta evolução no jogo em comparação com quem ouvia frases de encorajamento.

Além disso, o estudo — que foi apresentado na Conferência Internacional da IEEE sobre Comunicação Interativa Humana e Robótica em Nova Déli, na Índia, no mês passado — descobriu que a conversa fiada não precisava necessariamente vir de um robô tão sofisticado quanto o Pepper. Mesmo um dispositivo sem forma humanoide, como um computador, pode afetar o comportamento de uma pessoa ao usar feedback negativo. Esse é o aspecto mais preocupante.

Robôs podem afetar saúde mental

O estudo traz informações importantes sobre a influência que os robôs podem exercer na humanidade — mesmo os assistentes de voz com inteligência artificial podem afetar as tomadas de decisão e a saúde mental.

No lado positivo, há o potencial de as máquinas serem realmente úteis para melhorar a saúde mental com respostas inteligentes a comentários e perguntas. Elas também podem servir como companhia para quem simplesmente não quer ficar sozinho, oferecendo palavras eficazes de encorajamento.

No entanto, se um assistente pessoal ou inteligência artificial automatizada estiver trabalhando com objetivos opostos aos interesses de um ser humano, há potencial para abuso, como essa pesquisa pôde concluir. Imagine um assistente de compras de uma loja programado para fazer os clientes se sentirem inferiores para comprarem itens mais caros ou para criticar suas inseguranças ao escolher itens mais baratos.

A maneira como um robô ou uma IA responde a um ser humano — as emoções usadas, as palavras escolhidas ao dar uma resposta — pode ser ainda mais importante do sua capacidade de compreender e falar com precisão.