Redes neurais são ótimas até quando erram feio e criam “comédia computacional”

Quando uma rede neural saberá quem é Yoda? Quando elas criarão piadas próprias? E quando elas reconhecerão pessoas importantes do mundo?

Pode não demorar muito tempo, pois modelos de redes neurais estão progredindo a uma velocidade impressionante. Mas ainda há um longo caminho a ser seguido, como demonstrado por um experimento de Samim Winiger, que normalmente atende apenas por Samim. Ele se intitula um “engenheiro de narrativa” e brinca com inteligência artificial e aprendizado de máquina para desenvolver novas formas de se contar uma história.

Samim pediu para uma rede neural criar legendas para uma série de vídeos de cultura pop, além de trechos de filmes, para ilustrar como varia a precisão desses algoritmos – eles produzem algumas das descrições mais estúpidas e engraçadas para nomes como Kanye West, Luke Skywalker e até o robô Big Dog.

“Mulher deitada na cama com laptop”

Em seu trabalho mais recente, Samim fez um experimento para ver como redes neurais conseguem legendar vídeos da cultura pop. Ele usou um modelo de código aberto desenvolvido pelo Google e pela Universidade de Stanford chamado NeuralTalk, que olha uma imagem e faz uma breve descrição dela.

Ele produziu dois vídeos com montagens contando as histórias. No primeiro, a NeuralTalk conseguiu identificar tudo em uma imagem com sucesso:

Mas Samim não queria só mostrar como as redes neurais são boas no reconhecimento de imagens; ele queria mostrar como elas podem errar feio também. Samim se interessa por humor – o que ele chama de “comédia computacional”.

É o tipo de comédia que acontece quando a IA cometem erros, mas Samim destaca que isso também pode ajudar humanos a entenderem as inteligências artificiais.

“Humor e comédia são importantes para a educação”, ele me explicou por email. “Especialmente quando os erros de um sistema são uma boa forma de mostrar os avanços e implicações da tecnologia na sociedade.”

Assim, eis os casos em que ela errou muito feio:

Nos últimos meses, ouvimos falar bastante em aprendizado de máquina: vimos redes neurais sonharem, conversarem com facilidade, e até copiarem o trabalho de artistas famosos. Graças a uma crescente comunidade de pessoas que testam e publicam experimentos online em plataformas como o GitXiv, também temos bons exemplos de como esses algoritmos avançam.

É um problema muito mais complexo do que nosso cérebro naturalmente detalhado pode pensar. A rede precisa ser treinada em linguagem natural não apenas para identificar o que há na imagem, mas também para descrever a relação entre os múltiplos elementos de uma cena usando sentenças estruturadas.

É a vanguarda do aprendizado de máquina, e um projeto fascinante por ser avançado. No entanto, ele ainda tem um longo caminho a percorrer, como aponta Samim.

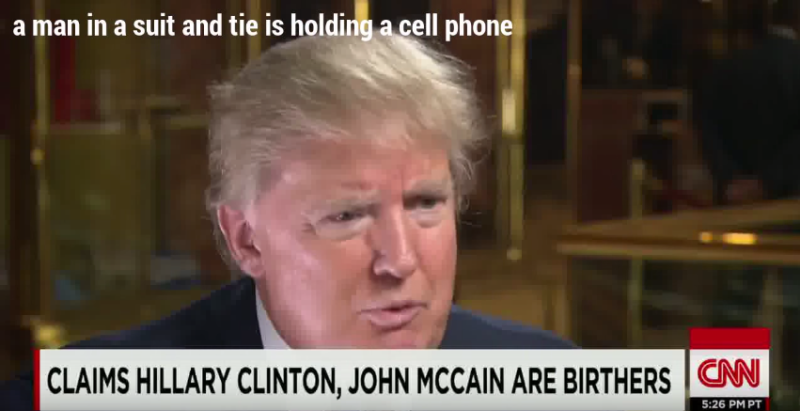

“Homem de terno e gravata segurando um celular”

“Homem andando de skate em uma rampa”

“Homem andando a cavalo em uma estrada de terra”

“Prato branco com pedaço de bolo”

“Gato sentado em uma privada no banheiro”

É verdade que são muitos os exemplos em que a NeuralTalk colocou uma legenda correta na imagem – mas o absurdo das legendas incorretas é o que realmente importa aqui. A rede pode acertar em alguns momentos, mas em outros ela está tão errada que nos deixa claro como é necessária uma matemática extremamente complexa por trás dessas formas emergentes de inteligência artificial.

Modelos de rede neurais precisam ser “ensinados” a reconhecer objetos e mais coisas em imagens. Da mesma forma que o Deep Dream imaginava certos tipos de alucinações com base no que engenheiros do Google ensinaram, outras redes neurais só são especialistas em coisas que aprenderam.

A comédia computacional não está aí apenas para nos fazer sorrir com erros de IA. Ela também é uma forma de inteligência que é frequentemente ignorada por pesquisadores. E por mais que muitos cientistas testem seus trabalhos a partir de métricas comuns que envolvem o reconhecimento de números e palavras, é algo muito mais complicado testar a compreensão sutil de piadas, criatividade e referências culturais.

Então o teste de Turing é uma forma um pouco simplista de julgar AI, diz Samim. “O humor é uma métrica muito mais difícil de se usar – é algo fundamentalmente humano e envolve nossas habilidades cognitivas em diversos níveis,” ele diz. Então sua Lei da Comédia Computacional faz um adendo crucial: “qualquer tecnologia suficientemente avançada vai desenvolver comédia.” Até lá, vamos continuar rindo da comédia involuntária causada pelas limitações da inteligência artificial.