Adobe quer fazer do Photoshop uma ferramenta para identificar fotos falsas

Por 30 anos, minuciosos manipuladores de pixels usaram o Photoshop para alterar e editar imagens. No entanto, agora os computadores podem criar fotos adulteradas por conta própria usando inteligência artificial avançada, a Adobe quer aproveitar suas ferramentas de edição de imagens para ajudar a verificar a autenticidade das fotos.

Como relata a Wired, a Adobe fez parceria com um punhado de empresas no ano passado para ajudar a desenvolver sua Iniciativa de Autenticidade de Conteúdo (Content Authenticity Initiative ou CAI, em inglês): um padrão aberto que marca as fotos com metadados protegidos criptograficamente. Isso incluiria o nome do fotógrafo, quando a foto foi tirada, o local exato em que imagem foi capturada e o nome dos editores que podem ter manipulado a foto de alguma maneira ao longo do caminho, mesmo que seja apenas uma correção básica de cor.

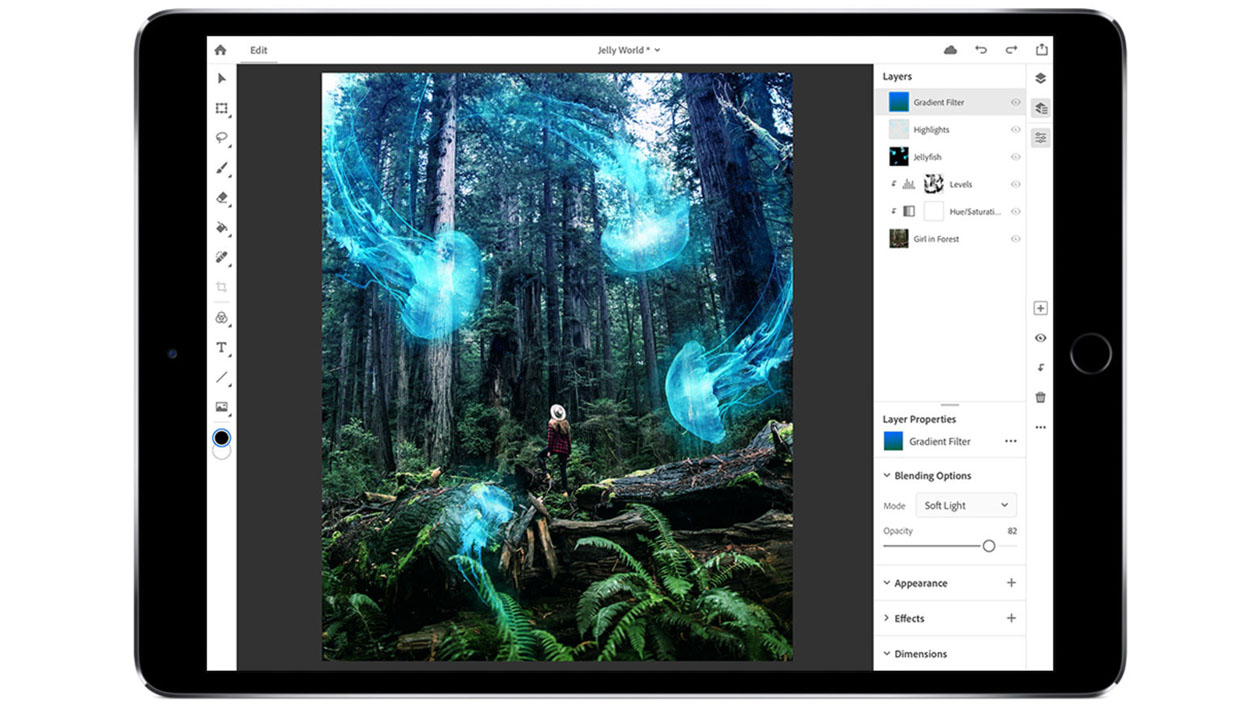

Ainda este ano, a Adobe planeja incorporar os recursos de marcação CAI em um preview do Photoshop para que, à medida que as imagens sejam abertas, processadas e salvas através do aplicativo, um registro de quem manipulou ou alterou a foto pode ser continuamente documentado em um registro embutido na própria imagem.

O sistema CAI também incluirá informações sobre quando uma foto foi publicada em um site de notícias como o The New York Times (um dos primeiros parceiros da Adobe nesta iniciativa no ano passado) ou em uma rede social como o Behance da Adobe, em que usuários e artistas podem facilmente compartilhar suas criações online.

O sistema CAI tem o potencial de ajudar a desacelerar a disseminação de desinformação e fotos manipuladas, mas exigirá que os usuários tenham acesso aos metadados protegidos e tomem a iniciativa de verificar se uma imagem é autêntica. Por exemplo, se alguém postar no Facebook fotos no dia seguinte de um protesto violento, seria fácil desmascarar que elas foram tiradas anos antes em outra parte do mundo.

Para ser eficaz, a abordagem CAI deve ser amplamente aceita e implementada em grande escala por aqueles que criam conteúdo fotográfico, publicam e consomem. Os fotógrafos que trabalham para agências de notícias oficiais podem facilmente ser obrigados a usá-lo, mas isso é uma pequena porção das imagens que são enviadas para a internet diariamente.

Por enquanto, não parece que gigantes da mídia social como o Twitter ou o Facebook (dono do Instagram) estejam planejando entrar no CAI, o que é problemático, dado que é onde chegam muitas das chamadas “fake news” são postadas e amplamente compartilhadas agora.

O uso de criptografia dificulta a alteração dos metadados, mas não a torna impossível. Também existe a possibilidade de eles serem completamente retirados de uma imagem e substituídos por informações falsas.

O sistema CAI, pelo menos em sua forma atual, não inclui nenhuma proteção para evitar que as pessoas façam capturas de tela e, em seguida, modifiquem as imagens assinadas e autorizadas. Um dia, essas proteções podem ser incorporadas a um sistema operacional, limitando a capacidade de capturar uma imagem com base em suas credenciais CAI, mas isso ainda está muito longe.

No mundo da fotografia digital, a Adobe tem muito peso e influência, e precisará usar isso para que sua Iniciativa de Autenticidade de Conteúdo tenha alguma esperança de ser uma ferramenta eficaz contra falsificações. Ter um punhado de jornais de grande nome como parceiros não é suficiente. O suporte para o sistema CAI precisaria ser incorporado a câmeras digitais, computadores, dispositivos móveis e qualquer plataforma que possa ser usada para compartilhar imagens em massa.

Também seria necessário que ele viesse acompanhado de um grande incentivo para educar os usuários sobre como acessar essas informações para detectar notícias falsas. Isso, porém, não bastaria: os próprios usuários também precisariam ter a iniciativa de dedicar alguns segundos extras para verificar se uma imagem é real ou não — e esse pode ser o maior obstáculo.

Se a pandemia nos ensinou alguma coisa, é que as pessoas estão ansiosas para acreditar em qualquer coisa que endosse seus próprios ideais, não importa o que os especialistas tenham a dizer.