Clearview AI entra com pedido de patente para oferecer reconhecimento facial até em encontros

A Clearview AI, agora sinônimo de vigilância sem supervisão, entrou com um pedido de patente abrangente que prevê entregar os usos mais perigosos da tecnologia de reconhecimento facial para quase qualquer pessoa. Segundo a solicitação, a tecnologia permitiria que os usuários enviassem uma foto e obtivessem instantaneamente informações, incluindo, mas não se limitando a, estado de saúde mental, situação de moradia, uso de drogas, endereço residencial, e-mail e site do empregador para usos sugeridos como “encontros”.

“Em muitos casos, pode ser desejável que um indivíduo saiba mais sobre uma pessoa que conheceu, por exemplo, por meio de negócios, encontros ou outro relacionamento”, diz o pedido. Ele segue descrevendo que uma “pessoa recém-conhecida” pode fornecer um cartão de visita falso ou falsificar informações “orais ou escritas”. “Alternativamente, pode-se pesquisar a pessoa recém-conhecida em um site ou para realizar verificações de antecedentes”, diz a empresa.

“No entanto, há muitos casos em que uma pessoa pode assumir um novo nome ou identidade para apresentar um nome falso e uma história ao indivíduo.” A Clearview AI afirma que poderia resolver este problema, fornecendo informações autênticas e biometricamente garantidas, coletadas da “Internet” (presumivelmente, plataformas de mídia social, embora várias delas tenham enviado notificações à Clearview AI), bem como “sites profissionais, sites de aplicação da lei ou departamentos de veículos motorizados”.

A solicitação, relatada pela primeira vez pelo Buzzfeed News, foi apresentada em agosto e se tornou pública na quinta-feira (11). Ela ainda está pendente de aprovação. Portanto, embora seja importante deixar claro que este é um pedido de patente que pode ou não se desenvolver em milhares de permutações, até mesmo a versão menos prejudicial parece bastante sombria, dado o longo desinteresse da Clearview AI em relação a consentimento.

No início do ano passado, o New York Times revelou que a Clearview AI compilou um banco de dados de mais de três bilhões de imagens de perfis de mídia social sem o conhecimento dos usuários. Logo depois que a história foi publicada, o cofundador da Clearview AI Hoan Ton-That fez uma demonstração do aplicativo para a CNN, capturando fotos dos rostos do apresentador e do produtor e recuperando bibliotecas de imagens de seu passado, incluindo fotos mal iluminadas do Facebook de anos atrás e fotos do Instagram que haviam se tornado privadas.

Enquanto a empresa mantinha segredo sobre sua lista de clientes, documentos vazados para o Buzzfeed News mostraram que a empresa ofereceu suas ferramentas para mais de 2.200 agências de aplicação da lei, incluindo o Serviço de Imigração e Controle de Aduanas dos Estados Unidos, bem como entidades privadas como Macy’s, Bank of America e um fundo soberano dos Emirados Árabes Unidos.

As revelações geraram uma série de ações judiciais alegando uma violação da Lei de Privacidade de Informações Biométricas de Illinois (BIPA) e todos os tipos de temores justificados de organizações de direitos civis sobre o uso de dados pessoais. A ACLU apontou que, efetivamente, privar as multidões do anonimato pode impedir as pessoas de protestar, participar de grupos de apoio ou frequentar reuniões religiosas. Isso pode representar uma ameaça ainda maior para as vítimas de exploração sexual, imigrantes sem documentos e pessoas de minorias étnicas.

Um dos muitos elementos preocupantes deste pedido de patente é a linha do tempo. Em maio de 2020, poucos meses antes do pedido de patente ser apresentado, o advogado da Clearview AI procurou reassegurar um tribunal de Illinois que “os clientes da Clearview estão atualmente limitados a entidades governamentais e policiais não pertencentes a Illinois”. O Buzzfeed News noticiou sobre outros documentos que declaravam que a empresa iria “evitar transações com clientes não governamentais em qualquer lugar”.

Em um comunicado enviado ao Gizmodo, a Clearview AI disse que sua tecnologia “atualmente só é usada por policiais para investigações após o crime”.

“Não temos a intenção de lançar uma versão da Clearview AI para usuários comuns”, acrescentou a empresa. O pedido de patente parece uma apresentação comercial exatamente para essa finalidade.

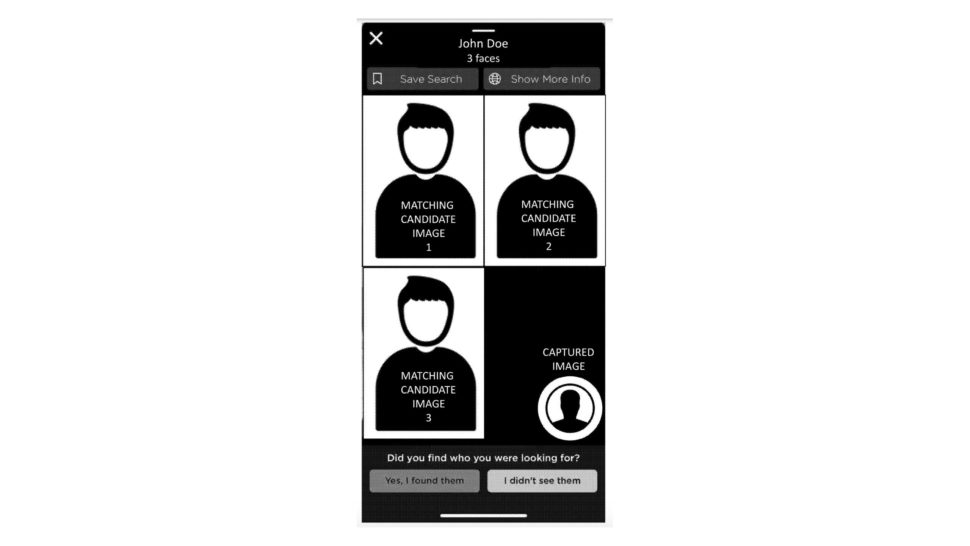

Captura de tela: US Patent and Trademark Office

Captura de tela: US Patent and Trademark Office

A patente menciona potenciais permutações comerciais mais moderadas, como autenticação de titulares de contas bancárias; de forma mais ameaçadora, há a possibilidade de criar redes fechadas para clientes de “varejo” e “imobiliário” “para compartilhar retratos faciais de indivíduos de alto risco”.

Obviamente, assim como as promessas da Clearview de reduzir os contratos privados, esses exemplos não são limites legais; não há nada no pedido de patente que possa impedir um corretor de imóveis de se recusar a mostrar uma casa porque descobriu a filiação religiosa de uma pessoa ou um registro antigo em sua ficha criminal. Em novembro passado, o Departamento de Polícia de Los Angeles proibiu o uso de tecnologia externa de reconhecimento facial após descobrir que os detetives estavam usando a Clearview AI sem autorização.

O pedido de patente da Clearview AI até valida os piores temores dos defensores da privacidade de que tal tecnologia possa ser usada para traçar o perfil de pessoas com base na vulnerabilidade de habitação e problemas relacionados ao abuso de substâncias. Além de classificações como uma pessoa “desconhecida” ou “recém-conhecida”, a Clearview AI diz que esta tecnologia pode ser usada para avaliar “uma pessoa com memória deficiente, um criminoso, uma pessoa intoxicada, um usuário de drogas” ou “um morador de rua.”

A Clearview AI imagina um cenário em que alguém possa apontar uma câmera para uma pessoa e descobrir que ela já viveu na rua. “Em um exemplo, as informações podem ser usadas por assistentes sociais para identificar moradores de rua ou necessitados”, diz a patente. Em outro exemplo, um policial poderia obter instantaneamente suas informações de saúde sem o seu consentimento. “Uma pessoa com histórico de prisões por dirigir sob a influência de álcool ou de qualquer outra substância psicoativa, revelado pelos escaneamentos faciais, pode ser tratada de forma diferente de uma pessoa com histórico de sintomas diabéticos de hipoglicemia”, diz o artigo.

E (de novo, hipoteticamente!) as informações coletadas podem afetar não apenas essa pessoa, mas também qualquer pessoa afiliada a ela; o uso da ferramenta pode trazer informações sobre colegas de trabalho, amigos, família e parceiro de um indivíduo. Isso é chamado de “pesquisa de rosto correlativa”, que ajuda a identificar personagens secundários que apareceram nas fotos ao lado deles.

O Escritório de Patentes e Marcas dos EUA se recusou a comentar se leva em consideração possíveis violações éticas e legais no processo de revisão de patentes.

A Clearview AI ainda está lutando para defender o que considera seu direito com base na Primeira Emenda de capitalizar bilhões de imagens, independentemente do dano potencial às pessoas que as publicaram. (Uma lei federal ainda não foi criada e os estados estão lentamente se juntando à liderança de Illinois em regulamentações de privacidade biométrica.) A ACLU, que está processando a Clearview AI em nome de profissionais do sexo, sobreviventes de violência doméstica, imigrantes sem documentos e outros, contesta que a Clearview tem permissão para coletar imagens, mas não (pelo menos em Illinois) para capturar impressões faciais sem consentimento.

“Aceitar o argumento contrário da Clearview significaria concordar que coletar impressões digitais de locais públicos, gerar perfis de DNA de células da pele publicamente disponíveis ou decifrar uma senha privada a partir de asteriscos mostrados em uma tela de login pública também são ações totalmente válidas”, escreveu a ACLU em uma postagem recente. O grupo compara os atos de vigilância da Clearview com o roubo de documentos e escuta telefônica. “Em outras palavras, o fato de um ladrão ter a intenção de publicar documentos que eles roubam não significa que o roubo está protegido pela Primeira Emenda.”