Como a invenção do software de planilhas popularizou para o mundo soluções do mercado financeiro

Em 2010, dois pesquisadores publicaram um controverso artigo sobre economia. Foi citado pelos políticos do Reino Unido para justificar medidas de austeridade que provocaram crises econômicas e de emprego e protestos contra a austeridade – medidas que as Nações Unidas mais tarde as chamou de “punitivas, mesquinhas e muitas vezes insensíveis” infligindo “grande miséria”. Em 2013, no entanto, foi percebido que esse influente trabalho tinha várias falhas em suas estimativas, em parte graças a um erro simples de planilha: especificamente, “algumas linhas deixadas de fora de uma equação para calcular a média dos valores em uma coluna,” o Guardian escreveu na época.

Esse famoso erro é apenas um dos muitos casos em que as previsões digitais nos decepcionaram, criando um nítido contraste entre a realidade das coisas e o que os números previram.

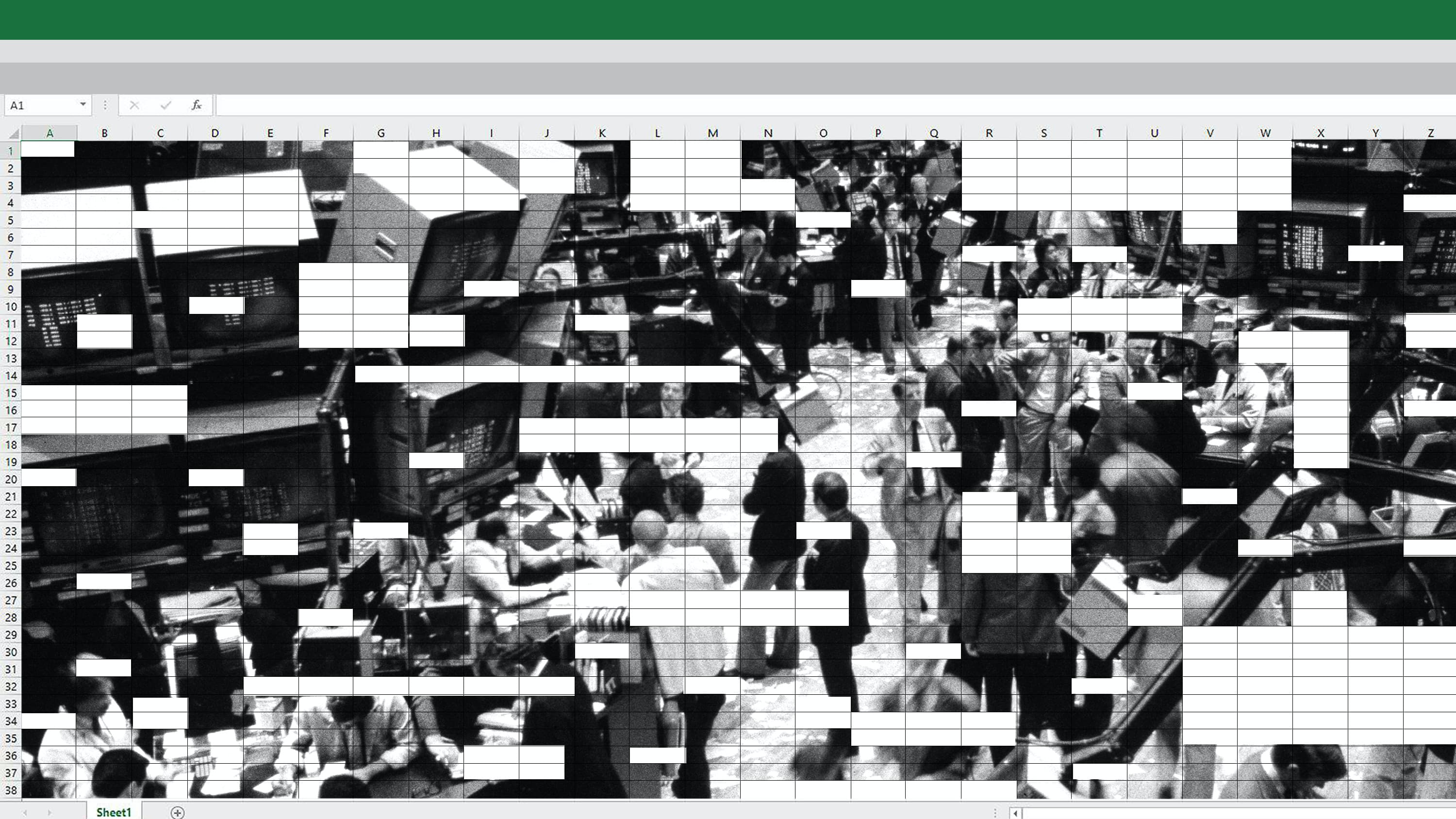

Por quase 40 anos, as pessoas que financiam e moldam os mercados mundiais contam com esse tipo de previsão, usando ferramentas digitais para calcular os riscos, benefícios e cenários de longo prazo de cada produto ou investimento. As pessoas que estudaram a transição das finanças para a tecnologia, ou que as viram em primeira mão, dizem que essas inovações podem ser rastreadas até um tipo de software revolucionário: a planilha.

“Comparo as planilhas a um jogo de computador para executivos”

Com o surgimento de planilhas e computadores pessoais, a indústria comercial e o “mercado de ações”, que antes dependiam de placas de argila, telescópios ou telégrafos para conseguir uma vantagem competitiva — também construiu novos domínios de atividade monetária, muitas vezes buscando vincular as receitas de amanhã aos resultados de hoje.

Segundo alguns especialistas, as planilhas (notoriamente imperfeitas) também podem ser responsáveis por uma certa falibilidade que parece endêmica aos mercados modernos – em outras palavras, cria vulnerabilidades em nosso sistema financeiro e maneiras de usar dados que apenas retrospectivamente conseguiriam prever.

Contas e riscos: um (muito) breve histórico

Segundo o historiador da tecnologia Martin Campbell-Kelly, o erro de planilha 2010 acima mencionado tornou-se “uma calamidade absoluta” para os políticos que haviam acreditado no artigo no Reino Unido e nos EUA. Mas não foi exatamente surpreendente. Campbell-Kelly, professor emérito da Universidade de Warwick e um conhecido especialista em história da computação, disse em uma entrevista por telefone que confiar na inteligência das planilhas eletrônicas sempre envolveu um certo risco.

“Comparo as planilhas a um jogo de computador para executivos”, disse ele. “Eles simulam situações do mundo real, e você pode alterar os parâmetros para ver como os diferentes cenários financeiros se desenrolam”.

Como as grandes planilhas em papel que as gerações anteriores de contadores e financistas estendiam através de suas mesas inteiras, as versões eletrônicas têm um desenho bastante simples: grandes grades, organizadas em colunas e linhas, permitem que os usuários registrem e comparem seus dados lado a lado como valores numéricos, como o custo deste ou daquele produto ao longo do tempo.

Diferentemente das planilhas tradicionais, que exigiam dezenas ou centenas de horas de matemática complicada feita à mão, as planilhas eletrônicas ofereceram realizar grande parte do trabalho para os usuários, usando fórmulas internas para calcular centenas de valores de acordo com inúmeras variáveis.

Quando o software de planilhas se tornou amplamente conhecido na década de 1980, os funcionários da área financeira passaram repentinamente a gastar menos dos seus dias usando caneta, papel e as ainda em uso calculadoras HP-12C para operar os números, embora os programas mais antigos ainda levassem algumas horas para concluir os cálculos.

Lixo entra…

Esta tecnologia também automaticamente introduz prós e contras, disse Campbell-Kelly. “Com planilhas físicas, era um trabalho muito mais longo, mas você teria um conhecimento muito mais íntimo do que realmente está dentro dela. Com as planilhas de computador, existem formulários escondidos dentro delas, dos quais você provavelmente não estará ciente”.

No geral, ele disse: “Existe um problema real com as planilhas, que sempre foi um problema sério: elas possuem recursos de verificação de erros muito baixos. Você pode procurar por algumas coisas, como definições circulares, nas quais duas variáveis são dependentes de código de uma maneira que não deveriam ser”.

“Mas se houver um erro em uma planilha, é realmente muito difícil de detectar – diferente dos programa de computador, onde existem ferramentas para verificar o software em geral. O programa de computador comum é muito mais confiável do que a planilha comum”.

“Elas são realmente bastante vulneráveis a pequenos erros e muito frágeis, sem mecanismo para dizer se elas saíram dos trilhos”.

Por exemplo: “Uma análise nos anos 80 descobriu que uma fração surpreendentemente alta de planilhas continha erros lógicos”. Em resumo, esses tipos de erros de programação podem fazer com que um programa opere incorretamente — produzindo resultados incorretos ou não intencionais — sem fazer com que ele desligue ou “trave”, o que deixaria aparente que há um problema.

Campbell-Kelly apontou que a qualidade dos dados que os usuários inserem nas planilhas também pode alterar significativamente a confiabilidade dos resultados.

Ele lembrou uma frase que passou a significar esse tipo de problema entre programadores e outros manipuladores de números: “Lixo entra, lixo sai”. Em outras palavras, se as informações sobre um determinado tópico inserido no programa são de má qualidade ou são representativas, e/ou o programa está propenso a erros, os dados que ele produz provavelmente serão pouco confiáveis. No entanto parecemos confiar automaticamente nesses tipos de números.

As planilhas conduzem a revolução digital, apesar das falhas

No final da década de 1970, os trabalhadores de Wall Street já usavam processos de e-mails rudimentares, colocando-os entre os primeiros a adotar computadores pessoais fora das ciências, da academia e dos amadores caseiros, de acordo com o tecnólogo David Wolfe. Mas o caso de amor das finanças com os computadores realmente decolou no início dos anos 80, quando as planilhas chegaram, e as empresas começaram a fornecer treinamento interno aos funcionários para essa ferramenta – uma com a qual, ainda hoje, surpreendentemente poucos de nós se sentem à vontade.

Na época, esses programas inovadores incluíam o VisiCalc – a primeira planilha digital de todos os tempos e “o ‘aplicativo mestre’ para o Apple II”, disse Wolfe – junto com o Lotus 1-2-3, que oferecia recursos expandidos em algumas áreas, e também impulsionou os PCs da IBM.

Segundo Wolfe, codiretor do Laboratório de Políticas de Inovação da Escola Munk de Assuntos Globais e Políticas Públicas da Universidade de Toronto, “a planilha começou imediatamente a ser escolhida pelo setor de serviços financeiros por sua capacidade de fazer cálculos ‘e se’, como: e se a taxa mudar de 1% para 2%, como isso afetará meu capital de investimento?”.

Quase imediatamente, Wall Street também começou a usar a tecnologia para criar novos tipos mais complexos de negociação e investimentos. “Tornou-se uma ferramenta incrível para economizar tempo, mas também começou a contribuir para a criação de derivativos”, explicou Wolfe. Esse tipo de transação, que remete a milhares de anos atrás em suas formas mais antigas, envolve um valor acordado para certos recursos entre duas partes ao longo do tempo e é frequentemente usado na esperança de estabilizar mercados ou (talvez mais comumente) obter porcentagens se o valor do mundo real dos recursos aumentar.

“Derivados hipotecários, derivativos futuros — eles surgiram da capacidade de agrupar produtos e calcular valores de derivativos para eles”, disse Wolfe. “É aí que a interseção entre computação pessoal e planilhas pareceu acontecer”.

Jeffrey R. Diehl, diretor executivo e CEO do Rhode Island Infrastructure Bank, lembra claramente a transição para as planilhas, assim como o aumento de derivativos e outras operações de alta tecnologia: na época, Diehl tinha acabado de concluir seu MBA e aceitou um emprego no JP Morgan.

Diehl disse em uma entrevista por telefone que acha que as planilhas ajudaram a fortalecer e expandir o setor financeiro para melhor, mas nem sempre foi fácil, especialmente no início. E, apesar do programa de treinamento em informática da empresa, disse Diehl, seu chefe sempre o incentivou a verificar os números manualmente e a desenvolver a capacidade de “olhar para eles e ver se estão estranhos”.

Durante esses anos, Diehl trabalhou principalmente com trocas de moeda e títulos, que exigem cálculos complexos em torno dos mercados internacionais. Um dia, quando ele estava se preparando para iniciar uma troca digital inédita, ele deu uma última olhada nos números e, de fato, percebeu que eles estavam estranhos. Ele tentou avisar seus colegas, que acreditavam nos números; tarde da noite, Diehl recebeu um telefonema: ele estava certo e rapidamente ajudou a corrigir o erro.

Diehl disse que também era aparente que as planilhas não foram realmente projetadas ou equipadas inicialmente para fins financeiros. “Devido às peculiaridades na maneira como os programas funcionavam e às limitações no hardware, tivemos que ser criativos na maneira de usá-los”.

“O que eu descobri sobre como as pessoas interagiam com as planilhas nos anos 80 é que realmente não pensavam nelas como substitutos do julgamento humano, mas como uma espécie de capa de super-herói ou prótese”

Por exemplo, quando os funcionários do JP Morgan estavam usando o VisiCalc para suas calculadoras de desktop HP, descobriram que precisariam calcular os períodos financeiros em blocos de tamanhos diferentes porque o número máximo de células podia ser de 100 ou 200.

“Então, adquirimos um dos primeiros PCs IBM e passamos do VisiCalc para o Lotus 1-2-3”, disse Diehl. “Uma coisa que nos pegou de surpresa, curiosamente, é que o VisiCalc tem seu primeiro período financeiro designado como Período 1. No Lotus 1-2-3, o primeiro período de fluxo de caixa foi o Período 0”.

Nessa época, sua empresa estava considerando se deveria transferir os escritórios de Wall Street para o World Trade Center, como estratégia de longo prazo. “Estávamos analisando cenários de arrendamento versus compra em um fluxo de caixa de 75 anos”, explicou Diehl.

“O cara para quem eu trabalhei — na época o tesoureiro da empresa — me fez passar por todos esses cenários manualmente em uma calculadora HP. Foram 300 fluxos de caixa em um período de 75 anos… Mas foi assim que descobrimos que havia uma diferença em como o Lotus 1-2-3 tratava os fluxos de caixa em relação ao VisiCalc”.

No início dos anos 90, no entanto, ambos os programas tinham perdido o lugar para outro software, que acompanhava um pacote completo para escritório nas máquinas da empresa: o Microsoft Excel.

Não era o melhor ou mais inovador software de planilha, de acordo com a maioria dos historiadores da tecnologia. Mas nas próximas três décadas, o Excel se tornaria onipresente, de Wall Street a pequenas empresas.

Durante os anos 80 e início dos anos 90, grandes pilhas de impressões também eram um item principal em Wall Street durante as reuniões, de acordo com Will Deringer, professor assistente de ciência, tecnologia e sociedade do MIT, e ex bancário de investimentos e analista do grupo Blackstone.

Essas pilhas de papel geralmente não eram lidas, mas demonstravam que foram realizados cálculos de alta tecnologia. “Tornou-se importante mostrar o seu envolvimento com esse modo de pensar”, disse Deringer.

“As planilhas dão essa impressão de objetividade, certa precisão, porque elas parecem complicadas: há muitos dígitos, você pode reunir muitas idéias e pontos de dados, criar essas estruturas elaboradas e produzir o que parecem ser respostas incrivelmente precisas”.

“Mas, na verdade, elas são bastante vulneráveis a pequenos erros e muito frágeis, sem mecanismo para dizer se saíram dos trilhos”.

O ‘Rei dos Títulos não Desejados’ cai, mas os soldados de Wall Street perseveram

Depois que as planilhas atingiram Wall Street, inovações financeiras abundaram, mas com resultados mistos. Algumas novas ferramentas ou técnicas enfrentaram críticas, enquanto alguns inovadores, uma vez elogiados por suas visões, caíram em chamas. Outras tornaram-se parte integrante do mercado que conhecemos hoje.

“O que eu descobri sobre como as pessoas interagiam com as planilhas nos anos 80 é que elas não pensavam nelas como substitutos do julgamento humano, mas como uma espécie de capa de super-herói ou prótese”, disse Deringer.

“Elas ofereceram formas de pensar para as quais os profissionais financeiros já eram naturalmente inclinados, [já que] já pensavam em termos do que vai acontecer no futuro, o que isso significa hoje e como isso vai refletir de volta”.

“Calculadoras eram capazes de fazer uma versão simples disso, mas as planilhas permitem que você use essa ideia – projetando coisas que acontecerão no futuro e atribuindo valor hoje – de uma maneira incrivelmente poderosa”.

Ao longo dos anos 80, por exemplo, uma das figuras mais reconhecidas e admiradas a experimentar com números em Wall Street era Michael Milken, um premiado financista com MBA em Wharton.

“Milken, o chamado rei dos títulos não desejados, de certa forma criou o DNA de um mercado financeiro inteiramente novo, com o uso de coisas como títulos de alto rendimento, e foi de longe o financista mais influente da década de 1980”, disse Deringer. “Ele usava esses instrumentos específicos mais ou menos conforme os inventava e desenvolveu maneiras de ‘vender’ muitas das novas formas de transações financeiras, como aquisições alavancadas e aquisições hostis”.

Milken mais tarde se declarou culpado de violações de valores e impostos em um escândalo de Wall Street perto do final da década. Como resultado, Milken cumpriu 22 meses de prisão e pagou centenas de milhões em multas; a partir de 2018, ele também possuía um patrimônio líquido de cerca de US$ 3,7 bilhões.

Apesar dos problemas jurídicos de Milken e seus colegas, muitas dessas mesmas técnicas também sobreviveram nos anos 90, 2000 e além. De acordo com Harvey A. Silverglate, ex-advogado de Milken, “o maior problema de Milken era que algumas de suas manobras mais engenhosas, mas inteiramente lícitas, eram vistas por aqueles que inicialmente não as entendiam, como criminosas, precisamente porque eram novas – e muitas vezes extremamente rentáveis”.

“Eles realmente deixam claro que as pessoas no topo das instituições financeiras não entendiam completamente como os instrumentos projetados e usados pelas pessoas sob elas funcionavam. Eles fizeram apostas de bilhões de dólares sem entender o que estavam fazendo”

Durante a mesma época, enquanto Milken estava encantando investidores e ganhando bilhões, outra ferramenta financeira ganhou destaque graças às planilhas, de uma maneira que mudaria as finanças para sempre, disse Deringer: uma fórmula financeira conhecida como cálculo do “valor presente” e “considerada por alguns como a invenção mais importante na história das finanças modernas”, segundo Deringer.

Em resumo, ele disse: “Ele permite que você valorize o dinheiro que será alcançado no futuro. Um cálculo financeiro padrão que nos permite dizer qual é o valor hoje de US$ 100 em 20 anos; ou o que você teria que economizar hoje para ter US$ 100 em 20 anos, incluindo juros compostos?”. Antes, esse tipo de cálculo multifacetado seria efetivamente impossível; com planilhas, isso pode ser realizado em minutos.

É também um dos muitos sinais de que os financistas da década de 1980 estavam olhando cada vez mais para o futuro com suas transações, disse Deringer – novidade na época, mas o estado comum das coisas hoje em dia.

“Quando [o cálculo do valor presente] surgiu pela primeira vez, as pessoas pensaram que era meio estranho e contra-intuitivo”, ele explicou. “Agora, nas finanças, as pessoas tratam isso como tratamos a lei da gravidade – tão óbvio que é impossível imaginar como alguém pensaria de outra maneira”.

Vida e finanças em um mundo pós-A Jogada do Século

Em 2010, o jornalista Michael Lewis causou um grande impacto com seu livro de não-ficção A Jogada do Século, que deu aos americanos um olhar mais atento à crise financeira de 2007-2008, e também sobre aqueles que ousaram apostar contra o mercado. Entre outras coisas, o livro detalhou alguns dos comportamentos e ferramentas comerciais que impulsionaram essa catástrofe econômica.

Estas ferramentas incluem aquisições alavancadas e consolidação, obrigação de dívida colateralizada, e títulos de métodos lastreados em hipotecas que podem ser rastreados de volta para a chegada dos softwares de planilhas, e são parte do que David Wolfe chama de ‘matematização na indústria de serviços financeiros.’

Ao transferir grande parte do trabalho com números de fato para as ferramentas tecnológicas, Wolfe disse, as empresas financeiras aumentaram a distância entre quem toma as decisões e os impactos reais no mundo que seu trabalho causa.

Em relação aos colegas que trabalharam n’A Jogada do Século, Wolfe comentou: “Eles realmente deixam claro que as pessoas no topo das instituições financeiras não entendem completamente como os instrumentos projetados e usados pelas pessoas sob elas funcionam. Eles fizeram apostas de bilhões de dólares sem entender o que estavam fazendo. Eles conheciam as vantagens, mas não as desvantagens”.

Aliás, o chamado “Rei dos títulos não desejados” pode ter argumentado algo semelhante, disse Deringer; em poucas palavras, Milken sugeriu o determinismo tecnológico, um conceito que vive hoje em grandes empresas.

“Aparentemente alguma hora ele disse que, na verdade, se você quisesse identificar quem eram os verdadeiros culpados pelas novas formas de financiamento mais livres e moralmente irrepreensíveis que se desenvolveram nos anos 80, as pessoas que realmente deveriam procurar eram os inventores do VisiCalc”, disse Deringer.

“As pessoas investem nesses modelos até que eles quebrem, e quebrem espetacularmente”.

“É realmente interessante ouvir os financistas tentarem culpar a tecnologia”, continuou ele. “Esse é um fenômeno mais amplo que vemos em muitos domínios técnicos: uma tentativa de deslegitimar um certo tipo de responsabilidade humana por certas mudanças e problemas sociais, alegando que tudo estava carregado na tecnologia, fora do controle de qualquer pessoa. E eles defendem os dois lados”.

Segundo Deringer, o aumento do uso desses tipos de ferramentas de processamento de números em nossos sistemas sociais também apresenta riscos múltiplos e significativos, o que apontando o dedo para o fato de que a maneira como as decisões são tomadas e os serviços oferecidos a milhões de pessoas podem se tornar – como o mercado financeiro hoje em dia é – ainda mais opacos.

No geral, Deringer disse que sua pesquisa sobre tendências financeiras e tecnológicas nas últimas décadas sugere um comportamento “muito errático” em relação a dados e números em nossa sociedade.

“Por um lado, estamos muito acostumados a conceder um certo tipo de autoridade às evidências quantitativas e a tratá-las como mais fortes do que as evidências qualitativas. Mas, ao mesmo tempo, todos conhecemos exemplos de como as estatísticas são falíveis e podem facilmente dar errado”.

“É um fenômeno interessante: temos profunda fé nos números e também profundo ceticismo que parece estar entrelaçado. Somos muito mais medidos na maneira como tratamos as evidências qualitativas, como testemunhos em primeira mão, por exemplo, mas com números é muito mais dicotômico. ”

“O fenômeno das planilhas tem exemplos realmente interessantes”, acrescentou Deringer. “As pessoas investem nesses modelos até que eles quebrem, e quebrem espetacularmente”.

Deringer disse que espera que o aumento do jornalismo de dados, entre outras coisas, possa ajudar nossa cultura a ter uma mentalidade mais saudável (ou pelo menos mais comedida) em relação ao que os dados realmente fornecem.

“Uma de suas promessas é apresentar um novo modo, meio que recalibrar algumas de nossas expectativas e prestar muita atenção às evidências quantitativas, mas em um contexto muito mais rico, que considera os dados e as premissas contidas nela”.

Os críticos daquela polêmica pesquisa de 2010 que defendeu a austeridade, que enfrentou diversos ataques em vários níveis desde sua publicação, parecem concordar. Como o economista Paul Krugman opinou no New York Times em 2013, os problemas do artigo eram muito mais profundos do que as células de suas planilhas – eles também eram no campo humano, de fato: “Primeiro, eles omitiram alguns dados; segundo, eles usaram procedimentos estatísticos incomuns e altamente questionáveis; e, finalmente, sim, eles cometeram um erro no Excel”, ele escreveu.

O gestor de fundos David Schuchman colocou de outra forma na Forbes daquele ano, argumentando que o foco no erro Excel do estudo erra o ponto. “Na realidade, a única lição a ser tirada desse episódio é que a economia acadêmica, como muitas ciências sociais, se baseia em arrogância e pseudo-precisão”, escreveu ele. “E que o desejo moderno de exigir um estudo acadêmico para ‘provar’ ou justificar decisões intrinsecamente complexas e ambíguas é oposto ao pensamento claro”.

No futuro, Deringer disse: “Espero que possamos tratar as evidências numéricas de uma maneira muito mais rica, cética e respeitosa”.

Janet Burns é uma escritora freelancer de Nova York