Pressão social de robôs é a mais nova ameaça tecnológica para as crianças

Uma nova pesquisa mostra que as crianças são mais propensas que adultos a serem influenciados robôs, uma conclusão perturbadora, dado a rápida frequência com que crianças estão interagindo com máquinas socialmente inteligentes.

Um experimento liderado por Anna-Lisa Vollmer, da Bielefeld University, na Alemanha, é um lembrete importante de que as tecnologias modernas podem ter um efeito profundo nas crianças, influenciando a forma como elas pensam e expressam suas opiniões — até quando elas sabem, ou pelo menos suspeitam, que suas opiniões estejam erradas.

• Agora o robô bípede da Boston Dynamics faz corridas ao ar livre

O ponto do experimento de Vollmer foi medir o impacto social exercido por robôs em crianças e adultos, particularmente na forma em que a pressão exercida por pares feita por robôs pode contribuir com a conformidade social. Os resultados, publicados na Science Robotics, mostram que os adultos são imunes à influência robótica, mas o mesmo não pode ser dito sobre as crianças, que obedeceram (ou se acomodaram) às opiniões de um grupo de robôs, mesmo quando essas opiniões estavam claramente erradas. Esta pesquisa significa que nós precisamos ficar de olho nos efeitos sociais exercidos por robôs e a inteligência artificial nas crianças — um problema crescente dada a frequência com que crianças estão interagindo com máquinas sociais.

Captura de tela do paradigma de Asch. Crédito: Vollmer et al., Sci. Robot. 3, eaat7111 2018

A equipe de Vollmer usou uma técnica estabelecida desenvolvida pelo psicólogo Solomon Asch, agora conhecida como paradigma de Asch. Esta técnica mede como as pessoas se adequam aos outros durante um tarefa simples de julgamento visual. Neste caso, Vollmer pediu aos participantes para fazerem uma tarefa de correspondência de linhas verticais na tela de um computador.

O teste não é difícil, e é fácil saber quais das duas linhas se encaixam em um tamanho. O ponto é que o teste não é sobre precisão, mas avaliar a habilidade de os participantes resistirem à conformidade (ou influência) quando seus pares fornecem a resposta errada.

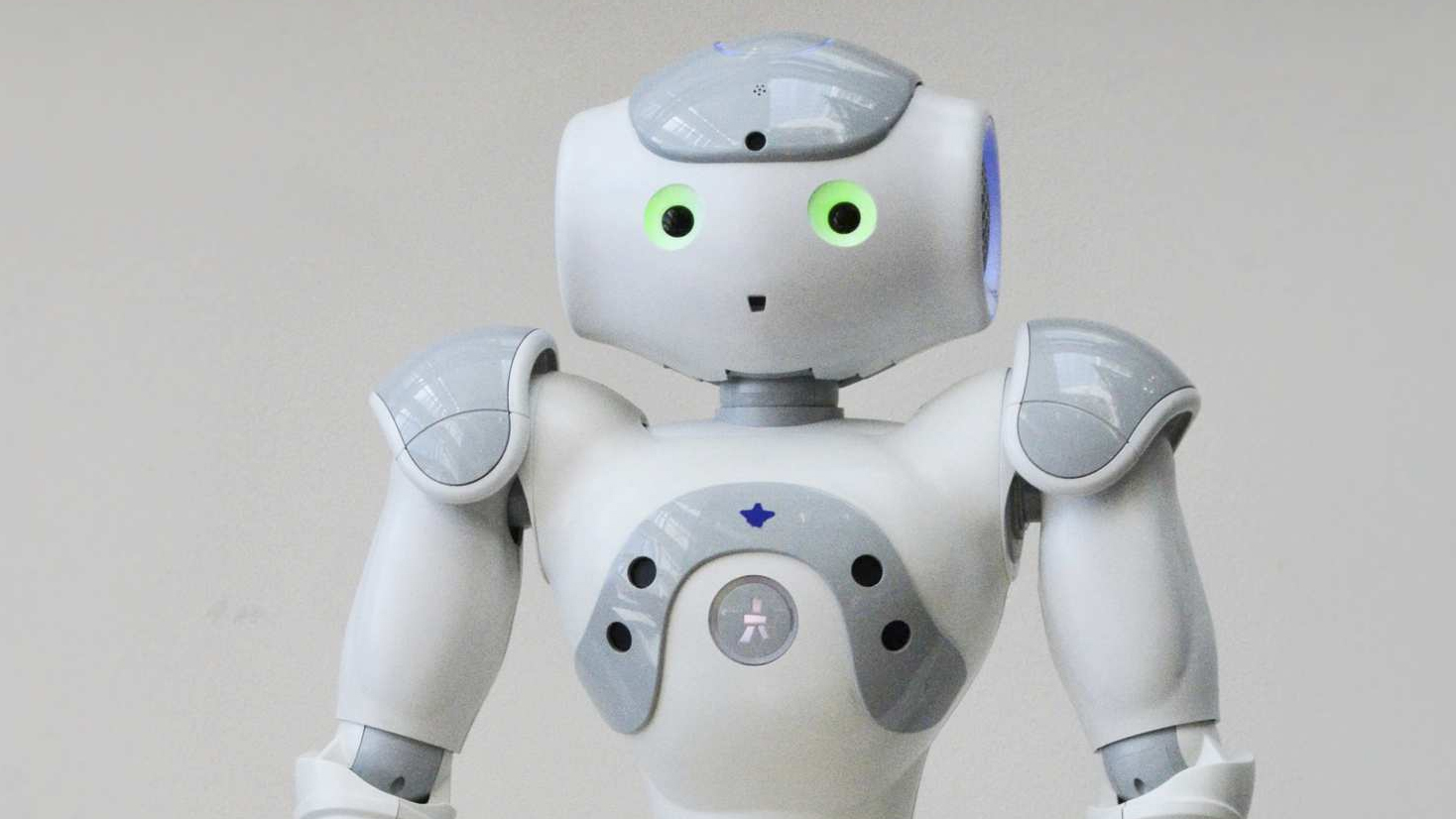

Para este novo estudo, Vollmer executou testes com adultos e crianças. Um total de 60 adultos foi dividido em três grupos: um formado por uma pessoa (de controle), um grupo com três outras pessoas e um grupo com três robôs (foi usado para o experimento robôs Nao, da Softbank Robotics).

Em 2/3 dos testes, todos os membros do grupo de pares (o de pares humanos e robóticos) unanimemente deram a resposta errada. Em conformidade com outros estudos, os adultos frequentemente concordam com as opiniões de seus pares humanos, mesmo quando as respostas são obviamente erradas. Mas os adultos não eram persuadidos pela pressão de pares exercida pelos robôs, resistindo às respostas incorretas impostas pelas máquinas.

O interessante é que esse estudo contraria a tese de que “os computadores são atores sociais”, que diz, nas palavras dos autores do estudo, que “as pessoas de forma natural e inconsciente tratam computadores e outras formas de mídia de uma forma que é fundamentalmente social, atribuindo qualidades humanas à tecnologia.”

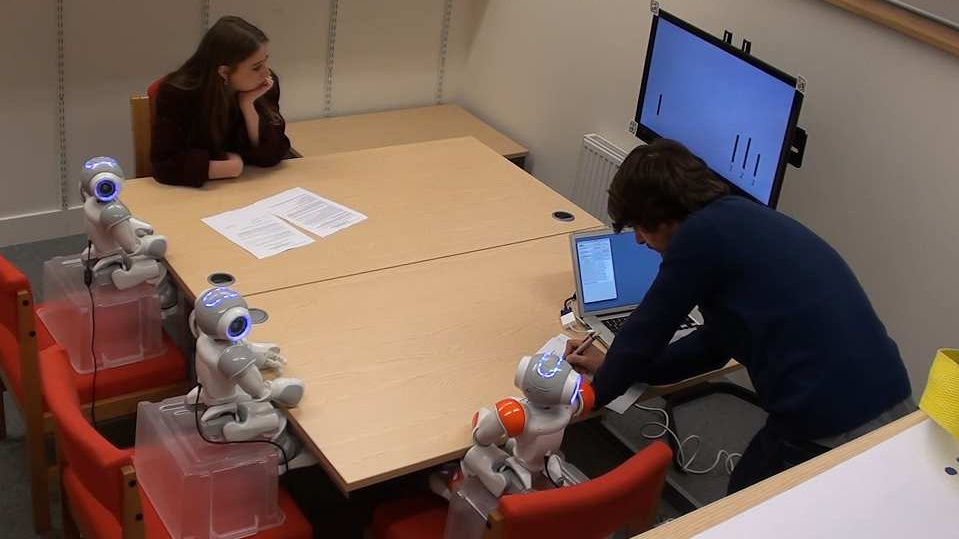

Teste com humanos e pares robôs. Crédito: Vollmer et al., Sci. Robot. 3, eaat7111 2018

O mesmo experimento foi feito com 43 crianças com idade entre 7 e 9. O teste era idêntico ao dado aos adultos, a única exceção é que não havia um grupo de pares humanos; já é sabido que as crianças são mais suscetíveis à pressão social. Neste caso, os pesquisadores queriam se concentrar nos pares robôs. Os resultados mostraram que, diferente dos adultos, as crianças foram “significantemente influenciadas” pela presença de pares robóticos, fornecendo respostas incorretas idênticas em quase 75% das vezes.

Uma possível explicação é que as crianças estão meramente reagindo à novidade da situação, que é compartilhar um espaço social com robôs. Mas “esta crítica não tem fundamento”, dizem os pesquisadores, pois não houve redução de precisão observada no grupo de controle.

Uma outra possibilidade é que as crianças se sentiram intimidadas pela presença de um adulto no experimento, que estava na sala durante a tarefa. Novamente, os pesquisadores discordam, dizendo que “isso ainda sugere que os robôs exerceram pressão de pares e não invalida as observações e conclusões”, acrescentando que robôs “provavelmente serão uma propriedade das pessoas ou organizações, e podem ser representantes para pressão social indireta.”

Teste de uma das 43 crianças com robôs. Crédito: Vollmer et al., Sci. Robot. 3, eaat7111 2018

Esta observação — de que robôs têm o aparente poder de induzir as crianças — é importante. Sobre o assunto, os pesquisadores escreveram no estudo:

Baseado nisso, é preciso ter cuidado ao projetar as aplicações e a inteligência artificial dessas máquinas, particularmente pelo fato de que se conhece pouco sobre o impacto à longo prazo que a exposição que robôs sociais podem ter no desenvolvimento de crianças e em partes vulneráveis da sociedade. Mais especificamente, problemas podem ser gerados não só pela programação intencional de comportamento malicioso (por exemplo: robôs criados para enganar), mas também pela presença não-intencional de vieses em sistemas de inteligência artificial ou má interpretação de dados reunidos de forma autônoma por um sistema que aprende sozinho. Por exemplo, se robôs recomendarem produtos, serviços ou preferências, vão estar em conformidade e em convergência com os métodos de publicidade mais tradicionais?

Posteriormente, os pesquisadores recomendam discussões contínuas sobre o assunto, como medidas de proteção como regulações de produtos para minimizar os riscos às crianças durante as interações com máquinas durante a infância.

Sem dúvidas, à medida que robôs socialmente inteligentes e inteligência artificial se tornam mais poderosos e difundidos, o potencial dano às crianças deve seguir o mesmo caminho. Este estudo mostra que as crianças não têm faculdade intelectual ou força emocional para resistir à influência exercida por essas tecnologias. É uma descoberta séria, que exige maior estudo e ação.

Imagem do topo por Vollmer et al., Sci. Robot. 3, eaat7111 2018