Novo robô do MIT consegue manusear delicadamente objetos que nunca viu

Robôs de fábricas são muito bons em pegar objetos que foram pré-programados para manusear, mas a história é diferente quando novos objetos são colocados diante deles. Para superar essa frustrante inflexibilidade, uma equipe de pesquisadores do MIT inventou um sistema que basicamente ensina robôs como avaliar por conta própria objetos desconhecidos.

• Como os robôs podem ajudar crianças autistas a melhorarem suas habilidades sociais

• Pressão social de robôs é a mais nova ameaça tecnológica para as crianças

No momento, os engenheiros têm basicamente duas opções quando se trata de desenvolver robôs feitos para agarrar objetos: algoritmos de aprendizado específico de tarefa e de agarramento generalizado. Como o nome indica, o aprendizado específico da tarefa está conectado a um trabalho em particular (por exemplo, pegar um parafuso e colocá-lo em uma peça) e normalmente ele não é generalizável para outras tarefas. O agarramento generalizado, por outro lado, permite aos robôs manusear objetos de diferentes formatos e tamanhos, mas ao custo de não conseguir executar tarefas mais complicadas, que exijam ajustes finos.

Os sistemas de agarramento robótico de hoje em dia ou são específicos demais ou básicos demais. Se algum dia chegarmos a desenvolver robôs capazes de limparem uma garagem ou de organizar uma cozinha bagunçada, vamos precisar de máquinas que consigam ensinar a si próprias sobre o mundo e todas as coisas nele. Mas, para os robôs conseguirem essas habilidades, eles precisam pensar mais como humanos. Este novo sistema desenvolvido por pesquisadores do Laboratório de Ciência da Computação e de Inteligência Artificial do MIT (CSAIL) nos deixa um passo mais próximos desse objetivo.

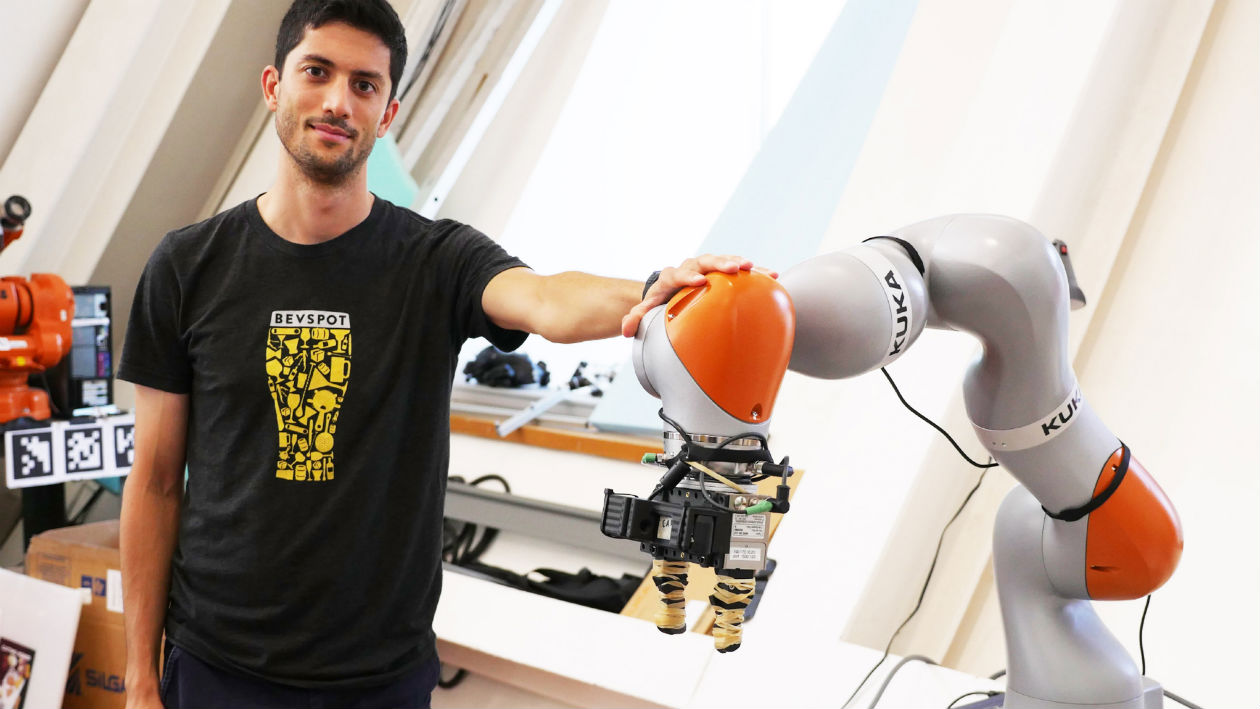

O sistema se chama Dense Object Nets (Redes Densas de Objeto, em tradução livre), ou DON. Essa rede neural gera uma impressão interna, ou um roteiro visual, de um objeto depois de uma breve inspeção visual (de cerca de 20 minutos, normalmente). Isso permite ao robô ter uma ideia do formato do objeto. De posse desse roteiro visual, o robô consegue, então, fazer a tarefa de pegar o objeto — apesar de nunca tê-lo visto antes. Os pesquisadores, liderados por Peter Florence, vão apresentar essa pesquisa em outubro, na Conferência de Aprendizagem de Robô em Zurique, na Suíça. Porém, por enquanto, você já pode checar o artigo no servidor de pré-impressão do arXiv.

Durante a fase de aprendizado, o DON vê um objeto a partir de vários ângulos. Ele reconhece pontos específicos no objeto e mapeia todos eles para formar um sistema de coordenadas gerais, o roteiro visual. Ao mapear esses pontos, o robô recebe uma impressão 3D do objeto. É importante apontar que o DON não é previamente treinado com conjuntos de dados rotulados, sendo capaz de construir seu roteiro visual de um objeto por vez sem qualquer ajuda humana. Os pesquisadores se referem a isso como aprendizado “autossupervisionado”.

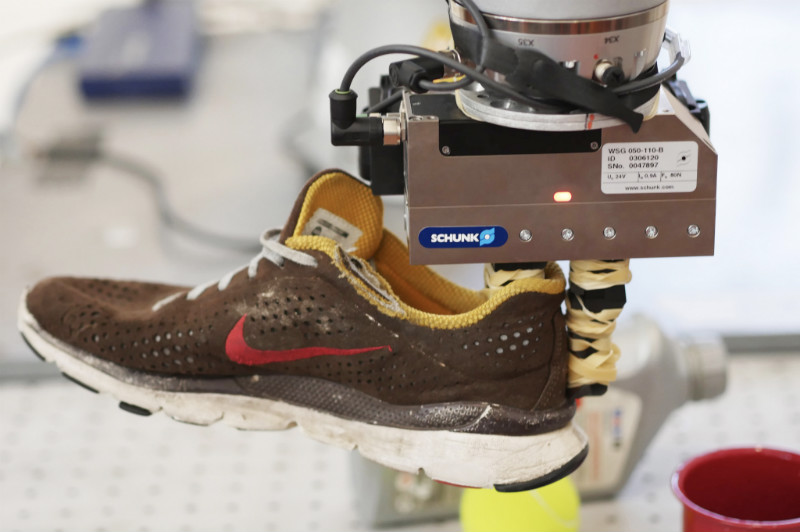

O sistema DON pegando um tênis marrom. Imagem: Tom Buehler/CSAIL

Uma vez que o treinamento é concluído, um operador humano pode apontar para um ponto específico em uma tela de computador, que diz ao robô em que parte do objeto ele deve pegar. Em testes, por exemplo, um braço robótico Kuka IIWA LRB levantou um sapato pela língua e um bicho de pelúcia pela orelha. O DON também é capaz de classificar objetos por tipo (sapatos, canecas e chapéus, por exemplo) e até de discernir exemplos específicos dentro de uma classe de objetos (como diferenciar um tênis marrom de um vermelho).

No futuro, uma versão mais sofisticada do DON poderia ser usada em diversas configurações, como coletando e organizando objetos em armazéns, trabalhando em ambientes perigosos e realizando tarefas de limpeza em casas e escritórios. Olhando adiante, os pesquisadores querem refinar o sistema de tal maneira que ele saiba onde agarrar em um objeto sem intervenção humana.

Pesquisadores têm trabalhado em visão computacional por grande parte das últimas quatro décadas, mas essa nova abordagem, em que uma rede neural ensina a si própria a entender o formato 3D de um objeto, parece particularmente frutífera. Às vezes, a melhor abordagem é fazer as máquinas pensarem como humanos.

Imagem do topo: Tom Buehler/CSAIL