Adobe está desenvolvendo ferramenta para detectar imagens que foram Photoshopadas

Em tempo de inteligências artificiais extremamente competentes na criação de desinformação, pode ser difícil detectar uma montagem bem feita. A Adobe é uma das empresas responsáveis pela criação de ferramentas que tornam possível essa sofisticação, mas também está trabalhando numa espécie de antídoto para montagens.

• TV russa photoshopou um sorriso esquisito no rosto do ditador Kim Jong Un

• Como identificar fotos falsas na internet

Se trata de uma ferramenta que utiliza machine learning (aprendizado de máquina) para identificar imagens editadas. O trabalho foi demonstrado neste mês durante a conferência de visão computacional CVPR, mas ainda está em estágio inicial de desenvolvimento – os resultados ainda não são lá essas coisas, mas levando em consideração a velocidade em que algoritmos têm aprendido novas tarefas, podemos esperar avanços significativos em um curto espaço de tempo.

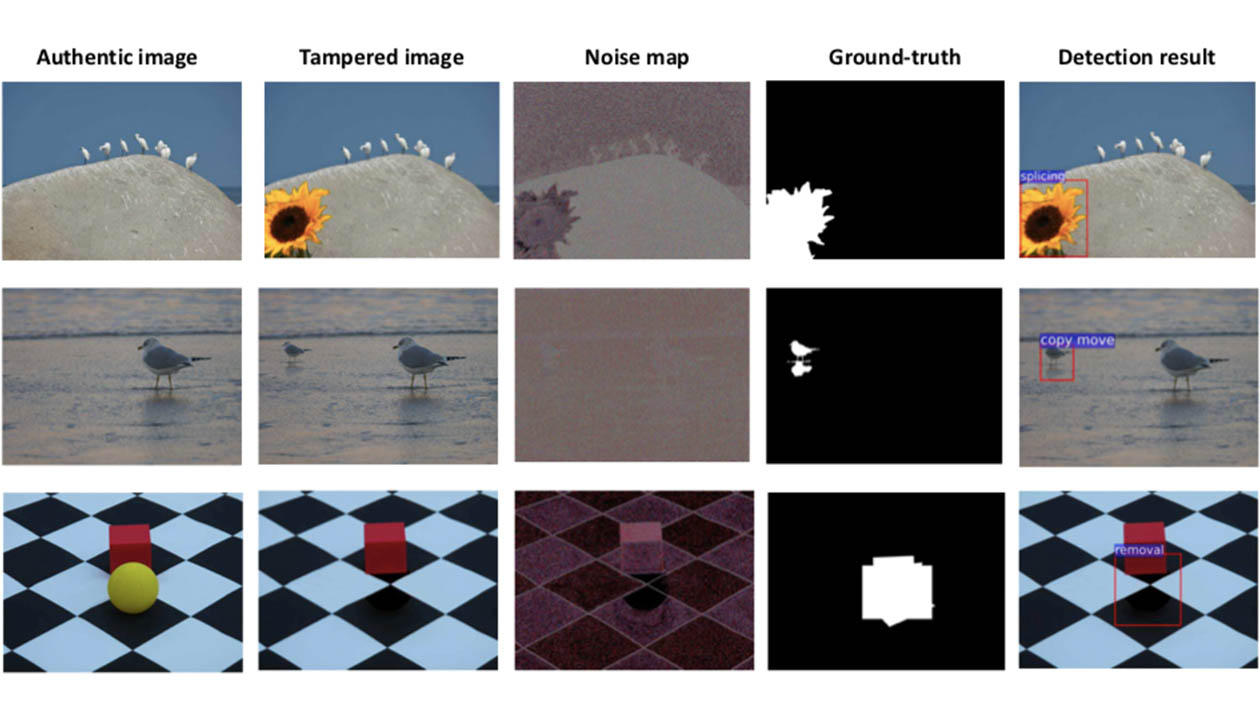

O artigo técnico apresentado pela Adobe mostra que o algoritmo pode ser utilizado para identificar três tipos comuns de manipulação de imagens: a junção, quando duas partes de diferentes imagens são combinadas; clonagem, quando objetos dentro de uma foto são copiadas e coladas; e remoção, quando um objeto é retirado do cenário.

Especialistas forenses procuram por sinais de edição nas camadas da imagem, como inconsistências de ruídos ou variações aleatórias de cores e brilho. Cada foto possui características únicas e, quando combinadas, podem apresentar pequenas diferenças que apontam manipulações.

Características de edição. Imagem: Adobe

Características de edição. Imagem: Adobe

Com base nisso, a Adobe alimentou uma inteligência artificial com inúmeras imagens e está ensinando padrões comuns de edições. Ainda existe campo para melhorias, caso a máquina aprenda a enxergar inconsistências em sombras e formas geométricas.

A ferramenta da companhia teve resultados ligeiramente melhores do que soluções similares desenvolvidas por outras equipes, então ainda há muito o que ser feito para se tornar uma opções viável para a detecção no dia a dia. Além disso, o algoritmo trabalha com imagens estáticas e não é capaz de detectar deepfakes – aqueles vídeos manipulados.

De acordo com o Verge, a Adobe pretende desempenhar um papel no “desenvolvimento de tecnologias que ajudem a monitorar e verificar a autenticidade de mídias digitais”. O que isso significa exatamente ainda não está claro, mas pode ser que um dia tenhamos um software para checar imagens potencialmente manipuladas.