Pesquisadores desenvolvem outro método assustador para criar deepfakes

Os deepfakes, vídeos falsos ultrarealistas que são manipulados por meio de machine learning, estão ficando bem convincentes. E pesquisadores continuam desenvolvendo novos métodos para criar esse tipo de vídeo. O método mais recente vem de pesquisadores da Universidade de Carnegie Mellon, que descobriram uma maneira de transferir automaticamente o “estilo” de uma pessoa para a outra.

• Produtora de vídeos quer colocar seu rosto no lugar de estrelas pornô usando deepfake

• Os vídeos de deepfake estão ficando inacreditavelmente bons

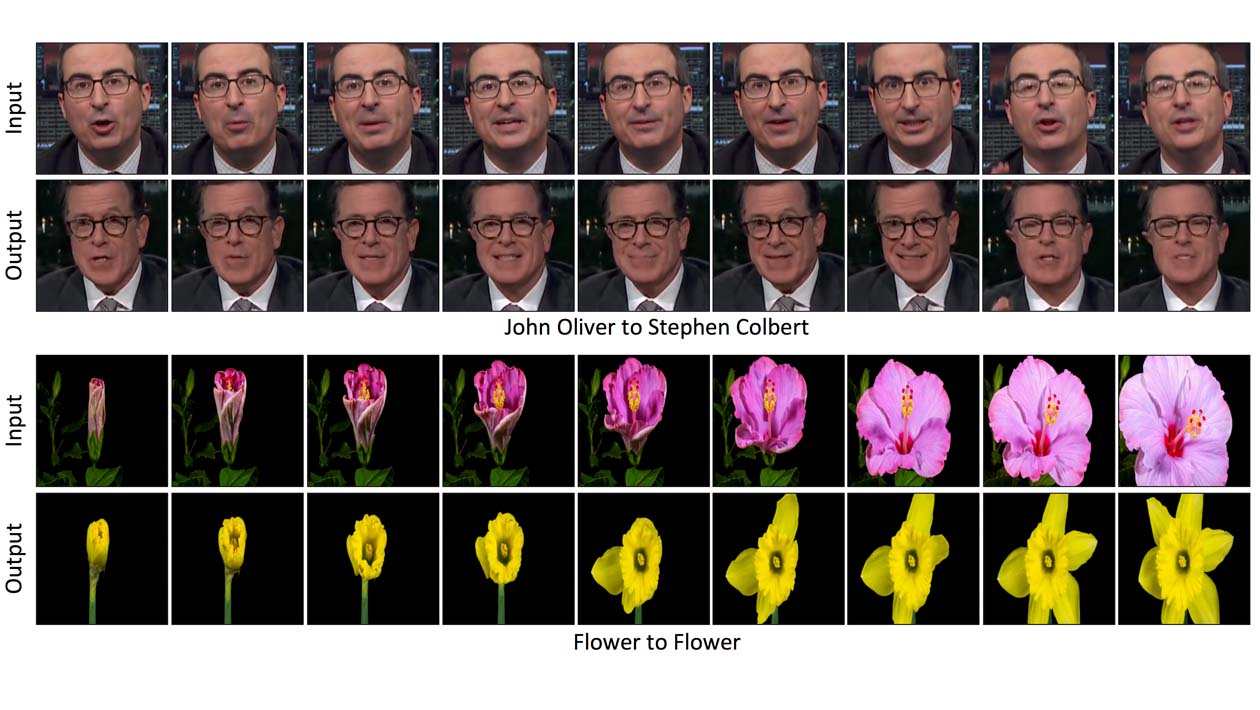

“Por exemplo, o estilo de Barack Obama pode ser transferido para Donald Trump”, escreveram os pesquisadores na descrição de um vídeo do YouTube que destaca os resultados do método. O vídeo mostra as expressões faciais do apresentador John Oliver para o outro apresentador Stephen Colbert e para um sapo animado; de Martin Luther King Jr. para Obama e de Obama para Trump.

O primeiro exemplo – Oliver para Colbert (ambos apresentadores da TV norte-americana) – está longe de ser um dos vídeos mais realísticos que já foram publicados utilizando técnicas de deepfakes. Ele parece ter baixa resolução e algumas expressões faciais borram em dados momentos. É quase como se eles tivessem tentando transmitir uma entrevista pela internet enquanto você está em uma péssima conexão. Os outros exemplos (excluindo o sapo) são muito mais convincentes, mostrando o espelhamento das expressões faciais e movimentos da boca do sujeito original.

Os pesquisadores descrevem o processo em um artigo como um “método não supervisionado guiado por dados”. Assim como outros métodos de desenvolvimento de deepfakes, essa técnica utiliza a inteligência artificial. O artigo não lida exclusivamente com a tradução de estilos de fala e de movimentos faciais de uma pessoa para outro – ele também inclui exemplos com flores desabrochando, nascer e pôr do sol, nuvens e vento.

Para os deepfakes envolvendo pessoas, os pesquisadores citam exemplos sobre como alguns maneirismos podem ser transferidos, incluindo “a covinha de John Oliver enquanto sorri, a forma característica da boca de Donald Trump e as linhas faciais da boca e o sorriso de Stephen Colbert”. A equipe utilizou vídeos disponíveis para o público para desenvolver esses deepfakes.

É fácil enxergar como essas técnicas podem ser aplicadas de maneiras inócuas. O exemplo do John Oliver e o desenho de um sapo, por exemplo, aponta para uma ferramenta bem útil para o desenvolvimento de animações realistas. Mas como já vimos, existem consequências com a proliferação dos deepfakes superrealistas – e dar esse tipo de munição para pessoas maliciosas. Em tempo, os deepfakes podem enganar o público e servir como uma ferramenta nefasta para a propaganda política.

Imagem do topo: Carnegie Mellon University