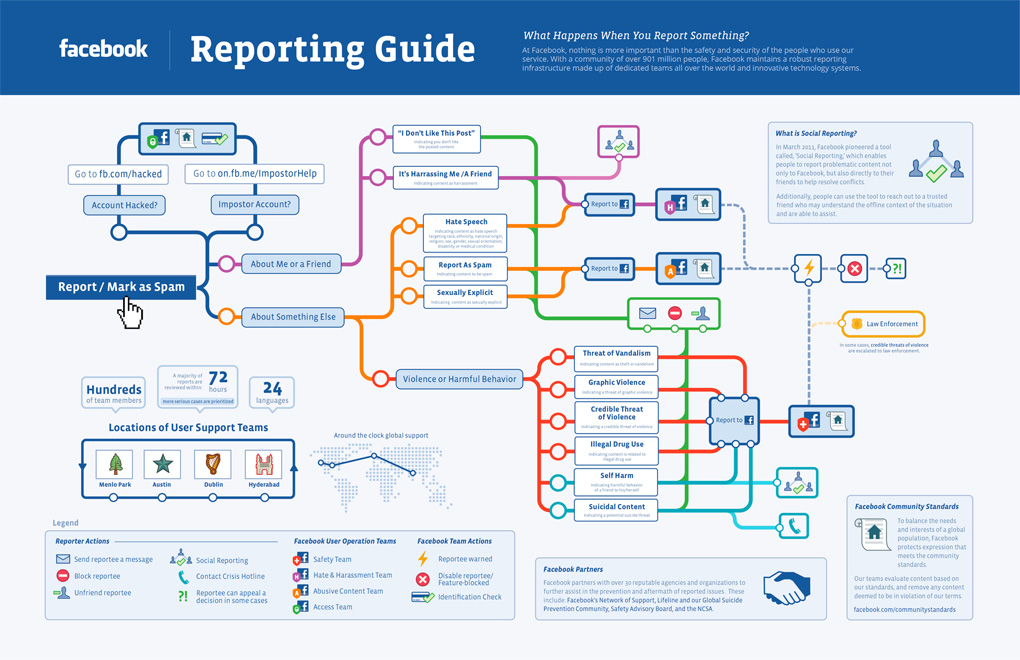

É isto o que acontece quando você reporta alguma coisa no Facebook

Algumas pessoas são bem babacas no Facebook. É gente mal educada que publica coisas racistas, sexistas, ofensivas de alguma forma. Você, claro, reporta/sinaliza esse conteúdo. Mas o que acontece quando você faz isso? O time de segurança do Facebook explica.

O guia acima (clique na imagem abaixo para ampliar) parece um pouco com o Jogo da Ratoeira e não é muito fácil de entender mesmo a empresa tendo simplificado um pouquinho o processo, mas ele explica que existem quatro times (Segurança, Ódio e assédio, Acesso e Conteúdo Abusivo) formado por centenas de funcionários que monitoram reclamações o dia todo de segunda a segunda. Do Facebook:

“Se um desses times determinar que um conteúdo reportado viola nossas políticas ou nossa declaração de direitos e responsabilidades, nós o removemos e alertamos a pessoa que o publicou. Além disso, nós podemos revogar a capacidade desse usuário compartilhar certos tipos de conteúdo ou usar certos recursos, desabilitar a conta do dele ou, se necessário, encaminhar a questão às autoridades. Nós também temos times especiais apenas para lidar com apelações de usuários sobre casos onde nós talvez tenhamos errado.”

Em uma comunidade com 900 milhões de usuários, é bom saber que o Facebook trabalha para tirar todo o nonsense do site — ainda que isso nem sempre funcione. [The Next Web]