Ferramenta do Google consegue cortar vídeos de forma inteligente para se adequar a diferentes telas

O Google lançou uma ferramenta de código aberto, o Autoflip, que pode tornar os problemas de enquadramento algo do passado, reestruturando inteligentemente o vídeo para ajustar corretamente as proporções de tela alternativas.

Em uma publicação em seu blog, a equipe de inteligência artificial do Google escreveu que as filmagens para computadores de televisão e desktop normalmente vêm no formato 16:9 ou 4:3, mas agora com dispositivos móveis ultrapassando a TV em termos de consumo de vídeo, as filmagens geralmente são exibidas em um maneira que parece estranha para o usuário final.

A solução para esse problema normalmente exige que “os curadores de vídeo identifiquem manualmente os conteúdos mais destacados em cada quadro, rastreiem suas transições de quadro a quadro e ajustem as regiões de corte de acordo com o vídeo”, absorvendo tempo e esforço que poderiam ser melhor gastos em outros trabalhos.

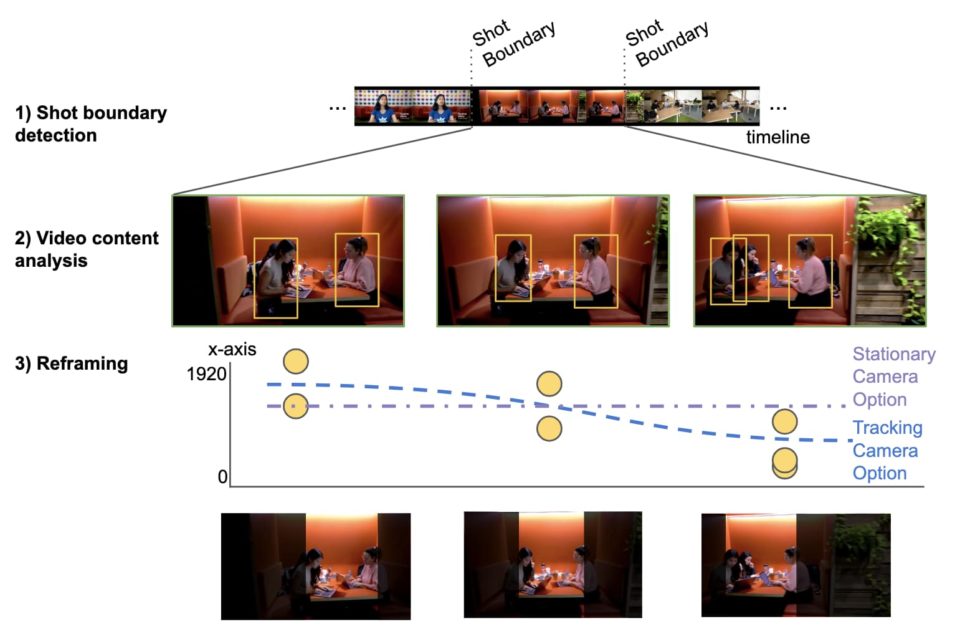

O Autoflip visa corrigir isso com uma estrutura que aplique técnicas de estabilizador de vídeo para manter a câmera focada no que é importante nas filmagens. Usando “tecnologias de detecção e rastreamento de objetos habilitadas para ML para entender de forma inteligente o conteúdo de vídeo”, construído na estrutura do MediaPipe, escreveu a equipe do Google, ele pode ajustar o enquadramento de um vídeo em tempo real.

Gif: Google AI

Além disso, o Autoflip se ajusta automaticamente entre as cenas, identificando “mudanças na composição que significam mudanças de cena para isolá-las para processamento”, de acordo com a empresa. Por fim, ele analisa cada cena para determinar se deve usar um quadro estático ou modo de rastreamento.

Gráfico: Google AI

Gráfico: Google AI

Isso é bem legal e oferece vantagens óbvias sobre o corte estático de vídeos, embora provavelmente seja mais adequado para coisas como imagens de notícias e vídeos do Snapchat do que filmes e programas de TV (onde é mais importante ver uma cena inteira).

Para uma explicação mais técnica de como tudo isso funciona, a equipe do Google AI explicou as várias tecnologias envolvidas em sua postagem no blog. O código-fonte do projeto também está disponível para visualização no Github, junto com instruções para testá-lo.