Guerra do Facebook contra as mentiras não está indo bem, dizem responsáveis por checagem de fatos

O assédio contra Julia e sua equipe começou em maio.

Foi nessa época que o Facebook trouxe sua iniciativa de verificação de fatos ao Brasil. Os verificadores de uma das orgaizações parceiras em que Julia (que não é seu nome real) trabalha como diretora foram alvo de grupos que achavam que a entidade estava censurando a direita.

O assédio se tornou tão ácido que a pequena equipe encerrou todas suas páginas pessoais em redes sociais. Eles estavam recebendo mensagens de trolls “dizendo que queriam atirar em nós, que não veríamos o próximo presidente do Brasil”, Julia conta ao Gizmodo. “As pessoas também disseram que seguiriam a gente, um por um.”

“Todos os dias, recebemos pelo menos de dois a quatro tuítes ou mensagens no Facebook dizendo que ou somos censuradores ou que não merecemos estar online, que deveríamos morrer…”

“Todos os dias, recebemos pelo menos de dois a quatro tuítes ou mensagens no Facebook dizendo que ou somos censuradores ou que não merecemos estar online, que deveríamos morrer ou algo assim”, afirmou Julia. “É bem ruim”. Ela acrescenta que “o Brasil está enlouquecendo no momento. Ou você é contra a verificação de fatos ou você fica calado sobre o assunto”.

O clima em torno das eleições é especialmente volátil no Brasil, onde a violência com motivações políticas não é incomum. O candidato presidencial da extrema-direita no Brasil, Jair Bolsonaro, foi recentemente acusado de “incitar ao ódio e à discriminação contra negros, comunidades indígenas, mulheres e gays”, escreve o New York Times. Seu filho, Eduardo Bolsonaro, foi acusado de ameaçar uma jornalista.

Os verificadores de fatos desempenham um papel crucial na responsabilização desses tipos de figuras públicas — desacreditando alegações perigosamente enganosas ou completamente falsas feitas por políticos e seus seguidores —, se posicionando como alvos para sua base rancorosa e agitada. Uma base que pode ver o ato não partidário de checar a verdade de uma afirmação como uma forma de censura ou ataque tendencioso contra seu grupo e suas ideologias.

É um duro sacrifício para o que se tornou um trabalho essencial na era da desinformação. A organização de Julia é apenas uma de várias ao redor do mundo que têm acordos de conteúdo com o Facebook. A gigante da tecnologia lançou um programa com verificadores de fatos independentes no fim de 2016 como parte de sua estratégia para combater notícias falsas em sua plataforma. A rede social tem divulgado uma série de táticas em sua guerra contra as mentiras, e são verificadores como Julia que recebem a tarefa de selecionar e filtrar certas afirmações falsas.

O programa do Facebook atualmente abarca 17 países. Todas as organizações são certificadas pela International Fact-Checking Network, uma unidade não partidária do Instituto Poynter de Estudos de Mídia lançada em setembro de 2015.

Vários verificadores de fatos que participam do programa confirmaram ao Gizmodo que o Facebook está lhes remunerando, como parte do acordo. A Factcheck.org, por exemplo, disseca o dinheiro que recebe em um relatório financeiro, que revela que o Facebook pagou à organização US$ 188.881 durante o ano fiscal de 2018, que acabou em 30 de junho de 2018.

“Não acho que vamos chegar a um estado de perfeição, sem desinformação online.”

Eles são todos especialistas terceirizados; o Facebook não tem uma equipe interna dedicada a esses esforços. Seu investimento nesse programa cresceu significativamente desde seu lançamento, há dois anos, expandindo globalmente, embora as equipes estejam longe de ser grande o bastante para checar todas as afirmações sinalizadas, uma limitação que o próprio Facebook reconheceu em um post em junho.

E vale apontar que não existem verificadores em todos os países e que, nas regiões em que existem, eles não têm gente ou tempo suficiente para checar cada publicação sinalizada. Um porta-voz do Facebook disse ao Gizmodo por e-mail que o programa de verificação de fatos conseguiu “reduzir visualizações futuras de histórias desmentidas em até 80%, mas vale apontar que não acreditamos que isso seja uma bala de prata para combater a desinformação”.

Em vez disso, o porta-voz listou uma série de abordagens que fazem parte da estratégia da empresa para combater as notícias falsas, incluindo a remoção de contas fake e o rebaixamento de conteúdo enganoso no Feed de Notícias. A companhia também afirmou recentemente que quer usar aprendizado de máquina para evitar a disseminação de desinformação na plataforma. Delegar o problema a máquinas não é uma resposta nada nova para a gigante das redes sociais.

Os especialistas foram trazidos depois que o público — e o Facebook — descobriu que a plataforma estava sendo explorada por agentes mal intencionados, usada como veículo para a interferência estrangeira nas eleições presidenciais dos Estados Unidos em 2016. À medida que o alcance desses usos foi vindo à tona, o Facebook anunciou que iria se apoiar nessas organizações de verificação para evitar que um abuso tão generalizado de seu serviço acontecesse novamente, especialmente em torno de discursos políticos.

A falha do Facebook em impedir o crescimento da desinformação em sua plataforma é um problema global. Em um ato de negligência especialmente perigoso, a incapacidade da rede de lidar com a desinformação e o discurso de ódio em Mianmar agiu como um catalisador da violência contra a população muçulmana na região.

Uma investigação da Reuters, publicada neste mês, revelou que o problema, que está no radar do Facebook desde pelo menos 2013, ainda recebe um tratamento inadequado. A agência de notícias descobriu mais de mil exemplos de “publicações, comentários, imagens e vídeos atacando os rohingyas ou outros muçulmanos de Mianmar que estavam no Facebook” até uma semana antes da reportagem ser publicada, no meio de agosto de 2018.

“Os insultos contra rohingyas e muçulmanos analisados para este artigo — que foram coletados pela Reuters e pelo Centro de Direitos Humanos da Escola de Direito da Universidade de Berkeley — incluem material que esteve no ar no Facebook por até seis anos”, escreve a Reuters.

Nesta segunda-feira (27), o Facebook anunciou que estava excluindo uma série de contas e páginas de Mianmar do serviço — incluindo o principal oficial militar da nação, o general Min Aung Hlaing — “para impedi-las de usar nosso serviço para inflamar ainda mais as tensões étnicas e religiosas”.

E um estudo publicado em maio deste ano, feito por pesquisadores da Universidade de Warwick, no Reino Unido, descobriu que comunidades na Alemanha com um uso de Facebook acima da média tinham mais ataques contra refugiados, uma relação que “se confirmava em virtualmente qualquer tipo de comunidade — cidade grande ou pequena; afluente ou com dificuldades; refúgio progressista ou fortaleza de extrema-direita —, sugerindo que a ligação se aplica universalmente”, escreve o New York Times.

Os dados ligando o Facebook a esses ataques são ainda mais perturbadores — “onde quer que o uso do Facebook por pessoa cresceu para um desvio padrão acima da média nacional, os ataques a refugiados cresceram em torno de 50%”, afirmou o New York Times.

A parceria do Facebook com verificadores de fatos está cada vez mais importante, à medida que períodos de eleição começam ao redor do mundo, em países em que os verificadores testam ferramentas antes de que elas sejam disponibilizadas para os verificadores nos Estados Unidos.

O Gizmodo conversou com sete verificadores de fatos de várias partes do mundo para saber sobre o estado atual dos esforços de verificação de fatos do Facebook, com diversos países se preparando para eleições por vir.

“É como um jogo de whack-a-mole.”

Vários verificadores de fatos expressaram sua preocupação com uma falta de transparência do Facebook em relação a dados e informações gerais específicas sobre o impacto de seu trabalho — queixas que os verificadores expressaram no ano passado, em uma reportagem do Politico.

Entretanto, como os verificadores assinaram acordos de não divulgação com o Facebook, eles não puderam discutir alguns tópicos publicamente. Embora eles estivessem evidentemente tranquilos em discutir certas partes do programa, havia certos tópicos sobre os quais eles não compartilharam informações na entrevista devido a esses acordos.

O painel

Os verificadores de fatos com quem conversamos detalharam o estado atual do “painel”, uma ferramenta que o Facebook desenvolveu para seus checadores terceirizados. Embora ele varie levemente de região a região, os responsáveis por conferir a autenticidade de notícias o descreveram como uma página com uma lista de artigos que foram sinalizados por uma combinação de usuários e algoritmos do Facebook, ranqueados então com base no quanto eles estão sendo compartilhados.

Quando os verificadores decidem quais itens revisar no painel, eles enviam ao Facebook uma avaliação entre oito opções disponíveis, que vão de “Falso” a “Sátira”, passando por “Opinião” e “Não Elegível”. Quando um verificador de fatos classifica um artigo como “Falso”, ele aparece mais embaixo no Feed de Notícias, e páginas e domínios que rotineiramente compartilham notícias falsas terão sua distribuição de conteúdo rebaixada e sua monetização e seus privilégios de anúncios removidos.

Embora os verificadores de fatos tenham expressado gratidão pelo painel, a maioria deles não pareceu achá-lo particularmente útil como uma ferramenta séria para combater desinformação. Em vez disso, a ferramenta oferece algumas indicações sobre o tipo de publicações que estavam sendo sinalizadas como falsas — um processo executado tanto por usuários quanto por um algoritmo.

Mas não é um sistema perfeito, especialmente agora que o entendimento sobre “notícias falsas” frequentemente é interpretado por humanos como aquelas notícias que não reafirmam suas crenças rígidas. “As pessoas tendem a marcar conteúdo com o qual não concordam”, diz Angie Holan, editora do PolitiFact, em entrevista ao Gizmodo.

Saranac Hale Spencer, da americana FactCheck.org, outra parceira de verificação de fatos terceirizada do Facebook, conta que o painel é uma ferramenta útil quando se trata de identificar o que os usuários podem sinalizar como suspeito, mas o caracterizou como “meio que não digno de nota”. Ela afirma que o foco da organização é responsabilizar personalidades públicas e que o projeto do Facebook é apenas uma pequena parte do que eles fazem.

“O painel não é realmente uma ferramenta para isso, se você está procurando por desinformação viral”, diz ao Gizmodo Phil Chetwynd, editor-chefe da AFP (Agence France-Presse), outra organização contratada pelo Facebook para o seu programa de verificação de fatos.

Chetwynd acrescenta que a AFP tem outras ferramentas e estratégias para identificar qual conteúdo vale a checagem de fatos, incluindo ferramentas do próprio Facebook, como o CrowdTangle, mas que o painel, em seu estado atual, “muitas vezes não é de muita ajuda” para esse propósito. Um porta-voz do Facebook confirmou ao Gizmodo que o painel em seu estado atual não prioriza o conteúdo por ser viral.

A AFP é uma das organizações que têm a capacidade de ver fotos e vídeos sinalizados dentro do painel. A organização de Julia também relata ter esse recurso, mas verificadores de fatos das Filipinas, da Alemanha e dos Estados Unidos dizem que ainda não têm acesso a isso e não sabem sobre quando terão. Um porta-voz do Facebook afirma que os checadores em Argentina, Brasil, França, Índia, Indonésia, Irlanda, México e Turquia atualmente têm a capacidade de verificar fotos e vídeos.

A ausência dessa ferramenta não significa que os verificadores de fatos não localizem fotos e vídeos fora do sistema do Facebook. Ellen Tordesillas, jornalista que ajudou a fundar a VERA Files, uma organização sem fins lucrativos nas Filipinas, disse que eles têm feito checagem de fotos e vídeos desde 2016.

A organização só iniciou sua parceria com o Facebook em abril deste ano, mas eles vêm fazendo checagem de fatos sob o National Endowment for Democracy desde a eleição presidencial de 2016. É um projeto separado do Facebook, mas Tordesillas diz que eles estão “intimamente relacionados”.

A capacidade de checar fotos e vídeos é uma funcionalidade essencial, especialmente em torno de campanhas políticas, à medida que teorias da conspiração e hoaxes estão cada vez mais sendo espalhados por meios visuais, sejam eles um meme, uma imagem manipulada, um vídeo do Facebook Watch ou um arquivo de mídia tirado de contexto.

E também existe um problema crescente com os deepfakes, vídeos falsos ultrarrealistas, uma nova maneira bastante preocupante de se fabricar desinformação. Um problema que até Marco Rubio decidiu enfrentar como seu projeto de estimação.

Embora nenhum dos verificadores de fatos tenha especificamente mencionado os deepfakes, eles mencionaram fotos manipuladas como uma fonte de desinformação. Um porta-voz do Facebook disse que a empresa está trabalhando em soluções técnicas e humanas para os deepfakes, em um esforço que envolve o seu laboratório de pesquisas de inteligência artificial.

A anatomia de uma mentira

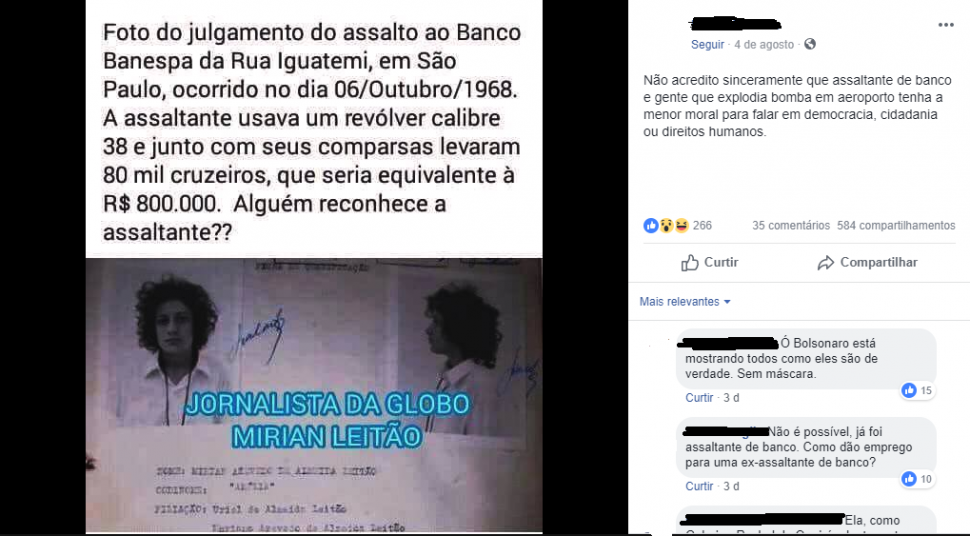

Vários verificadores detalharam como notícias falsas se espalham visualmente em suas respectivas regiões. Geralmente, elas envolvem assuntos polêmicos e campanhas políticas. A Agência Lupa, uma organização de verificação de fatos que está trabalhando com o Facebook no Brasil, disse que eles já apuraram a veracidade de duas fotos usando o painel da rede social. As duas fotos eram verdadeiras, mas foram postadas em um contexto falso.

Uma delas é uma foto da prisão da jornalista Miriam Leitão. Junto com ela, vinha uma foto a acusando de participar de um assalto à mão armada a um banco durante a ditadura no Brasil, em outubro de 1968.

A acusação era completamente falsa. Na época do roubo, Leitão tinha 15 anos de idade e morava em Caratinga, no interior de Minas Gerais. A foto foi tirada quatro anos depois, quando ela tinha 19 anos de idade, foi detida e ficou presa por meses enquanto estava grávida, segundo a Agência Lupa.

Isso foi durante o regime militar brasileiro. Leitão foi torturada e ameaçada de estupro enquanto esteve presa, segundo o jornal O Globo, e, depois de ser solta, foi processada por participar do Partido Comunista do Brasil. Ela nunca foi acusada de participar de um roubo armado a bancos.

A segunda foto era de Marco Antônio Cabral, filho do ex-governador do Rio de Janeiro, Sérgio Cabral. A imagem era real, mas, mais uma vez, o texto que acompanhava a foto era falso. Ele dizia que Marco Antônio, que concorre à reeleição no congresso, não iria usar seu sobrenome nas urnas para se distanciar do pai, que está atualmente preso. A acusação também era falsa.

Crédito: Agência Lupa

Jacques Pezet, que trabalha para a agência alemã CORRECTIV, mais uma parceira do Facebook, diz que trabalhou na verificação de um vídeo fora do painel da rede social, pois ele ainda não tem esse recurso. A organização identificou a peça depois de compartilhamentos em páginas de extrema-direita. Também houve uma sinalização por parte de um usuário do Twitter, que marcou a conta da CORRECTIV.

O vídeo, feito por um turista tcheco, mostra uma equipe de cinema filmando pessoas boiando no mar. O turista afirmou de maneira incorreta que se tratava de uma encenação de mortes de refugiados no mar próximo à ilha de Creta. A acusação foi divulgada para mostrar que a mídia manipula o público com imagens falsas.

Pezet diz que a pesquisa da organização mostra que a equipe estava de fato filmando uma cena, mas era para um docudrama histórico, Land of the Painful Mary, que trata dos refugiados gregos que foram, na década de 1920, realocados de Anatólia para Creta. O verificador entrou em contato com a equipe e com o diretor para confirmar que eles estavam filmando um documentário e provar que as legendas e o contexto eram falsos.

Chetwynd também comenta que eles verificaram fotos reais que foram tiradas de contexto, especificamente para manipular a discussão sobre imigração. Por exemplo, ele conta ter recentemente checado um vídeo, que supostamente retratava um homem saudita atacando o funcionário de um hospital em Londres. O post foi compartilhado mais de 40 mil vezes em menos de um mês no Facebook.

O incidente aconteceu e o vídeo é real, mas foi tirado de contexto “com a insinuação de que os imigrantes estão chegando e causando problemas”, diz Chetwynd. Na verdade, era o vídeo era de um homem kuwaitiano cuspindo e ofendendo uma enfermeira australiana durante uma discussão sobre dinheiro em uma clínica veterinária no Kuwait.

“Parece que estamos correndo atrás de sites o tempo todo sem saber se a notícia ainda está circulando no sistema”

Outro exemplo inclui um vídeo de um homem russo bêbado atacando um segurança e enfermeiras no noroeste da Rússia. Ele foi postado em uma página já removida, que se chamava “SOS anti-white racism” (“SOS racismo contra brancos”, em tradução livre) e compartilhado mais de 100 mil vezes, de acordo com a First Draft, falsamente apresentando a peça como um estrangeiro atacando funcionários de um hospital francês. Chetwynd diz que o mesmo vídeo foi usado em diferentes países com diferentes contextos, incluindo Turquia, Espanha e Itália.

“Sempre que você vê certos tipos de indivíduos, certas pessoas, certas personalidades se tornando parte do discurso, ou certos críticos se tornando proeminentes em uma semana ou por um certo período, você nota que eles passam a aparecer mais nesses sites dúbios que monitoramos” diz Gemma Mendoza, que lidera as iniciativas de verificação de fatos e pesquisas sobre desinformação nas redes sociais na Rappler, que fica nas Filipinas e também vem colaborando com o Facebook.

“Você passa a encontrar esses padrões. Parece que há um planejamento, como se eles também estivessem em sintonia com os eventos, exceto pelo conteúdo que é, em muitos casos, fabricado”, diz Mendoza. Os verificadores notaram que os sites que postam rotineiramente conteúdo falso ou enganoso se mantêm a par das notícias e frequentemente publicam informações falsas relacionadas a elas.

“Somos iniamigos”

Recursos para verificação de fotos e vídeos à parte, que ainda está em beta, os checadores querem que o Facebook dê mais informações sobre o impacto de seu trabalho. “Eles prometeram algumas métricas para nós”, diz Mendoza. Eles já viram alguns números hipotéticos, conta, mas ainda não receberam dados exatos específicos do material verificado.

Ela também nota que muitas informações falsas não vêm de apenas uma URL; elas circulam por muitos sites idênticos. A verificadora conta que gostaria de saber se o sistema está sinalizando a falsa matéria em si ou apenas a URL em que ela foi publicada. “Parece que estamos correndo atrás de sites o tempo todo sem saber se a notícia ainda está circulando no sistema”, diz ela.

Um porta-voz do Facebook disse que a empresa tem “processos de detecção de similaridade que usam aprendizagem de máquina para capturar notícias falsas duplicadas”. Em um post publicado em junho sobre essa nova técnica, a empresa disse que “um verificador na França desmascarou o artigo que dizia que você pode salvar uma pessoa que está tendo um derrame furando seu dedo com um alfinete e retirando sangue. Isso nos permitiu identificar mais de 20 domínios e mais de 1.400 links que estavam espalhando o mesmo texto”.

Não está claro se a ferramenta é sofisticada o suficiente para checar todas as notícias falsas semelhantes de diferentes domínios da internet. Por outro lado, sua existência já dá uma dimensão do que esses verificadores estão combatendo. “É como um jogo de whack-a-mole [aquele jogo em que toupeiras saem de buracos e você deve atingí-las com um martelo]”, diz Mendoza, descrevendo o esforço exigido para fazer com que esses sites sorrateiros parem de aparecer no Facebook.

Chetwynd diz que “o que todo mundo quer do Facebook é uma melhoria na qualidade das sinalizações do que é informação e do que é desinformação”, em alusão a um sistema de identificação de notícias falsas ou enganosas na plataforma. “É uma coisa que ainda estamos brigando para que eles nos forneçam.”

“Somos iniamigos”, diz Mendoza, se referindo ao relacionamento da organização com o Facebook.

Transparência não é um pedido fora da realidade. Os verificadores estão efetivamente solicitando evidências de que seu trabalho está fazendo diferença. E, quando se trata de um trabalho meticuloso — trabalho este que envolve aguentar uma ladainha de mensagens de ódio e ameaças de morte — isso ainda é muito pouco para o compromisso firmado.

Assumindo a responsabilidade

Em escala global, as parcerias de verificação de fatos são, talvez, uma das maiores soluções auto-professadas do Facebook para lidar com a questão da desinformação em sua plataforma. Em vez de desenvolver uma equipe interna dedicada a atacar o problema, o Facebook terceirizou o serviço.

Holan acha que isso foi muito inteligente. “O Facebook criou a plataforma e sabe como ela funciona, e nós somos verificadores e verificamos o conteúdo”, diz ela. (Entretanto, dá para contestar, já que aparentemente nem mesmo o Facebook entende realmente como sua plataforma funciona.)

“Eu não acho que vamos chegar a um estado de perfeição, em que não haja desinformação nas redes”, diz Holan, citando a natureza humana. Mas ela também acredita que as plataformas de tecnologia estão começando a entender como controlar que tipo de informação pode proliferar. “Eu acho que aquela coisa do Alex Jones que aconteceu [recentemente]… seu conteúdo ser removido das plataformas é muito interessante, um ponto de virada, em que as plataformas aceitaram seu papel como selecionadores.”

Ilustração do topo: Jim Cooke/Gizmodo