Google anuncia linguagem neural que promete assistentes de voz com falas mais naturais

Os investimentos do Google em linguagem neural são altos. E nesta terça-feira (18), a companhia anunciou mais novidades durante a conferência Google I/O, entre elas um modelo experimental chamado LaMDA (Language Model for Dialogue Applications, ou “Modelo de Linguagem para Aplicações de Diálogo”, na tradução livre). Segundo a empresa, a tecnologia proporciona aos assistentes de voz falas mais naturais e interativas.

Baseado em inteligência artificial, o LaMDA vai permitir que a maneira como os assistentes de voz conversam com os usuários seja ainda mais parecida com a fala humana. Sundar Pichai, CEO do Google, diz que a tecnologia, como tem se mostrado até agora, “pode conduzir uma conversa sobre qualquer tópico”. No entanto, como ainda está no estágio inicial de desenvolvimento, não é capaz de entregar resultados extremamente precisos.

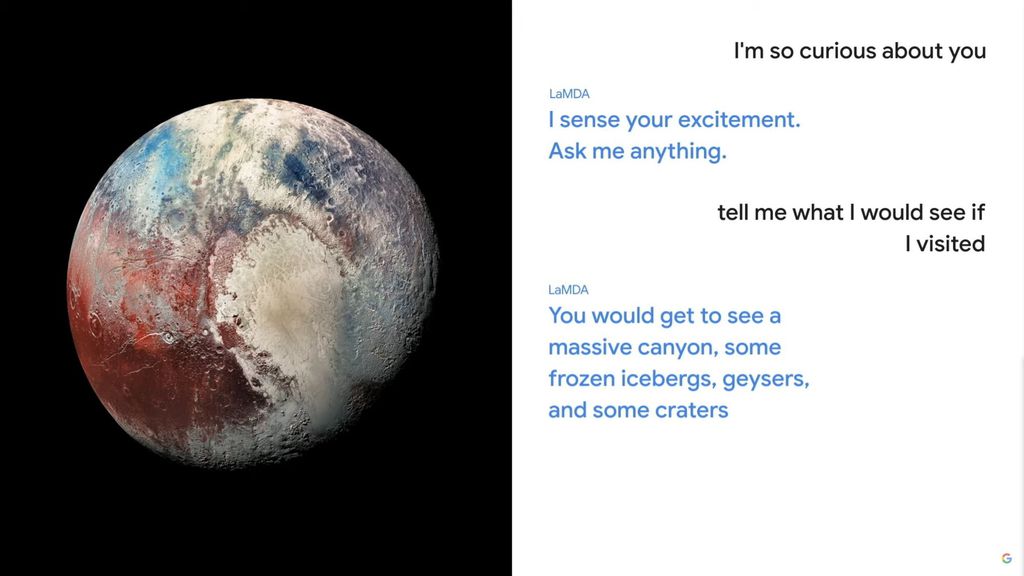

E quando ele diz “sobre qualquer tópico”, parece mesmo qualquer tipo de assunto. Para demonstrar as habilidades da tecnologia, a companhia exibiu dois exemplos. Em um deles, durante a conversa com um usuário, o LaMDA respondeu a questões como se fosse o planeta-anão Plutão, dando dicas caso alguém algum dia consiga ir até lá. No bate-papo, a linguagem neural do programa ainda forneceu fatos reais para dar mais veracidade à conversa, incluindo informações da sonda New Horizons, que passou por Plutão em julho de 2015.

O segundo exemplo foi o LaMDA se assumindo como um avião de papel. Nesse cenário, a inteligência artificial forneceu algumas sugestões de como voar mais longe e o que um avião de papel precisa para ser bom. A resposta foi que “o papel precisa ser bem rígido”. Então tá, né?

A linguagem neural LaMDA foi capaz de se passar pelo planeta-anão Plutão e fornecer respostas naturais. Imagem: Google

De acordo com Pichai, por enquanto, o LaMDA só entende texto. A ideia é que as próximas atualizações da tecnologia incluam a possibilidade de compreender imagens, áudio e “conceitos” — no caso, interações mais naturais. O CEO do Google também garantiu que a linguagem não seguirá modelos pré-definidos, como acontece hoje com os assistentes de voz, mas aprender com os usuários para nunca fornecer as mesmas respostas.

Pichai reforçou mais de uma vez que o LaMDA ainda está nos estágios iniciais de desenvolvimento, mas que o pouco que ele consegue fazer já impressionou toda a equipe do Google. Ao que tudo indica, a novidade parece ser um evolução ou algo que será incorporado ao Duplex, um recurso do Google Assistente que simula a voz humana em chamadas de voz.

Google anuncia investimentos em computação quântica

Para mostrar seu comprometimento na criação de novas tecnologias de inteligência artificial, o Google também revelou um campus dedicado a estudos e desenvolvimentos em computação quântica. A instalação fica em Santa Bárbara, na Califórnia, e será responsável não apenas pela concepção de projetos, mas pela sua fabricação. A empresa também espera que o edifício ajude a reduzir os erros comuns de máquinas tradicionais e, para isso, deve construir 1 milhão de qubits (bits quânticos) físicos.